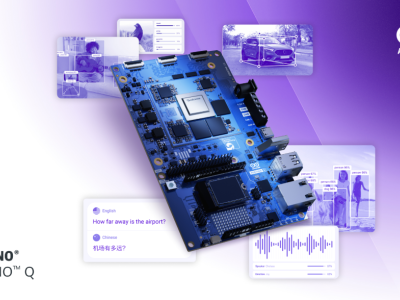

在人工智能技術(shù)持續(xù)突破的背景下,英偉達正式發(fā)布面向企業(yè)級多智能體系統(tǒng)的新一代開源大語言模型Nemotron 3 Super。該模型采用混合Mamba-Transformer骨干網(wǎng)絡(luò)架構(gòu),結(jié)合潛在專家混合模型(latent MoE)與多token預測(MTP)技術(shù),在推理效率上實現(xiàn)顯著突破——總參數(shù)量達1200億的模型僅需激活120億參數(shù)即可運行,原生支持100萬token的超長上下文處理能力,其推理吞吐量較前代產(chǎn)品提升超過五倍。

與行業(yè)常見的API服務(wù)模式不同,英偉達此次采取全面開源策略,不僅公開模型權(quán)重參數(shù),還同步開放預訓練及后訓練階段使用的完整數(shù)據(jù)集,并附上全流程訓練方案。這種開放模式為企業(yè)用戶提供了深度定制化空間,可基于自身業(yè)務(wù)需求調(diào)整模型性能,同時降低技術(shù)依賴風險。據(jù)技術(shù)文檔披露,模型在數(shù)學推理、代碼生成等復雜任務(wù)中展現(xiàn)出顯著優(yōu)勢,尤其在多智能體協(xié)同場景下,其長上下文處理能力可支持跨領(lǐng)域知識整合。

AI搜索領(lǐng)域頭部企業(yè)Perplexity已率先完成模型接入測試,成為首個商業(yè)化應(yīng)用案例。該公司技術(shù)團隊表示,Nemotron 3 Super的超長上下文窗口使其能夠直接處理完整文獻或代碼庫,大幅減少信息截斷導致的誤差。與此同時,企業(yè)軟件巨頭Palantir與西門子宣布啟動部署計劃,前者將模型整合至其數(shù)據(jù)分析平臺,后者則聚焦工業(yè)自動化場景的智能決策優(yōu)化。行業(yè)分析師指出,開源策略與硬件生態(tài)的深度綁定,或?qū)⒊蔀橛ミ_鞏固AI市場地位的關(guān)鍵舉措。