在人工智能研究領域,多模態(tài)深度研究正成為突破傳統(tǒng)信息處理邊界的關(guān)鍵方向。傳統(tǒng)模型在處理視覺與文本融合任務時,往往面臨兩大核心挑戰(zhàn):視覺檢索命中率不穩(wěn)定與推理深度不足。針對這些問題,最新研究提出將信息檢索從單次操作升級為動態(tài)交互過程,通過多輪試探、反饋與再檢索的循環(huán)機制,使模型在復雜環(huán)境中具備持續(xù)縮小搜索范圍、驗證關(guān)鍵信息的能力。

現(xiàn)有技術(shù)路線存在顯著缺陷。單次全圖檢索易受背景噪聲干擾,同一實體在不同尺度下的檢索結(jié)果波動劇烈,導致關(guān)鍵信息遺漏。多數(shù)模型推理軌跡短、工具調(diào)用次數(shù)有限,難以完成多跳證據(jù)聚合與復雜問題的試錯式驗證。研究團隊通過構(gòu)建多尺度視覺檢索系統(tǒng),結(jié)合文本深度研究能力,成功將推理輪數(shù)提升至數(shù)十輪,搜索引擎交互次數(shù)突破百次量級,顯著增強了模型在噪聲環(huán)境中的穩(wěn)定性。

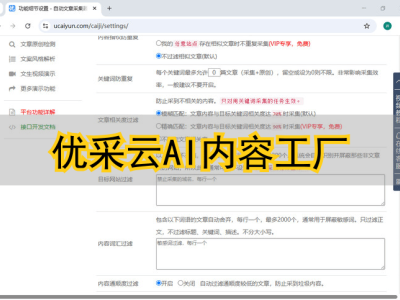

技術(shù)實現(xiàn)包含三大核心模塊。視覺檢索階段采用多實體定位與多尺度裁剪策略,模型自動生成多個邊界框并對不同區(qū)域并行檢索,有效提升關(guān)鍵信息捕獲率。證據(jù)處理階段構(gòu)建視覺-網(wǎng)頁-摘要-驗證的閉環(huán)流程,通過輔助模型過濾噪聲數(shù)據(jù)并提煉核心證據(jù)。跨模態(tài)推理階段將成熟的文本深度研究能力遷移至視覺領域,實現(xiàn)圖文信息的深度融合。訓練體系采用"長軌跡合成-冷啟動監(jiān)督微調(diào)-在線強化學習"的三階段方案,通過約3萬條高質(zhì)量軌跡數(shù)據(jù)完成初始訓練,再利用真實搜索環(huán)境中的強化學習優(yōu)化策略。

實驗數(shù)據(jù)驗證了技術(shù)路線的有效性。在VDR、FVQA等六個主流基準測試中,80億參數(shù)模型在相同設置下較前代產(chǎn)品平均提升10.4%,300億參數(shù)版本進一步將優(yōu)勢擴大至16%。特別值得注意的是,該模型在參數(shù)規(guī)模僅為GPT-5、Gemini-2.5-Pro等閉源系統(tǒng)十分之一的情況下,仍能取得相當甚至更優(yōu)的性能表現(xiàn)。消融實驗表明,多尺度裁剪策略使視覺命中率提升37%,結(jié)合文本搜索后整體準確率再提高22%,強化學習階段則通過優(yōu)化決策路徑使步驟效率提升40%。

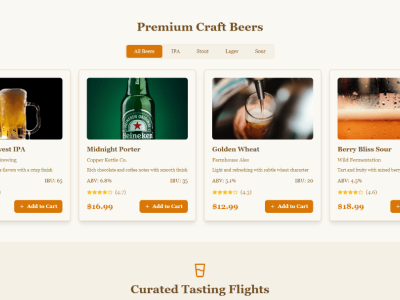

評測體系革新為技術(shù)發(fā)展提供新標準。傳統(tǒng)基準存在兩大系統(tǒng)性漏洞:問題文本常泄露答案線索,導致模型依賴先驗知識繞過視覺驗證;全圖檢索場景過于理想化,未能反映真實環(huán)境中的定位、裁剪與試錯需求。新提出的VDR-Bench基準包含2000條強制視覺搜索的多跳問題,覆蓋產(chǎn)品細節(jié)、地圖標識、報告表格等十大視覺領域。該基準通過人工裁剪顯著區(qū)域、實體驗證、知識圖譜擴展等嚴格流程,確保問題必須依賴局部檢索與多跳推理才能解答,有效杜絕了文本捷徑與全圖檢索漏洞。

技術(shù)突破帶來應用場景的質(zhì)變。在醫(yī)療診斷領域,模型可同時分析X光片與病歷文本,通過多輪交互驗證異常特征;在金融分析場景中,系統(tǒng)能夠交叉比對財報截圖與新聞文本,精準識別數(shù)據(jù)矛盾點;法律文書審查時,模型可自動定位合同條款與相關(guān)法條,構(gòu)建完整的證據(jù)鏈條。這些應用場景的共同特點是信息高度分散、需要跨模態(tài)深度推理,傳統(tǒng)模型往往因推理深度不足或視覺檢索不穩(wěn)定而失效。

研究團隊指出,多模態(tài)深度研究的核心挑戰(zhàn)在于構(gòu)建噪聲環(huán)境下的穩(wěn)定推理閉環(huán)。通過將檢索-推理過程分解為可量化的子任務,結(jié)合大規(guī)模合成數(shù)據(jù)與強化學習技術(shù),模型能夠自主形成"定位關(guān)鍵區(qū)域-驗證視覺證據(jù)-補充文本知識-再定位新區(qū)域"的迭代機制。這種內(nèi)生能力的形成,標志著人工智能系統(tǒng)向更接近人類認知模式的方向邁出重要一步,為解決復雜現(xiàn)實問題提供了新的技術(shù)范式。