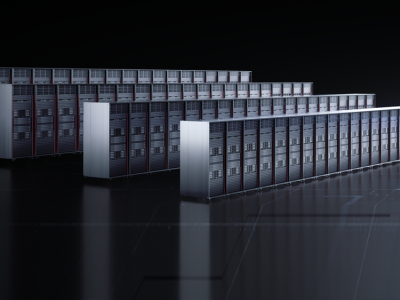

當下,AI發展重心正從“大模型”向“智能體”轉變。大模型時代,交互模式相對簡單,用戶輸入提示詞,模型經過思考給出答案。而智能體時代,交互變得復雜多樣,不僅有人機交互,還有機機交互。模型不僅要理解用戶話語,還需自主調用瀏覽器、代碼解釋器等工具與外部環境互動,交互次數從幾次激增至幾十次甚至上百次。在此過程中,智能體每次調用工具產生的輸入輸出雖短,可能僅幾百個token,但隨著交互輪次增加,上下文會不斷累積,最終形成幾十萬token的龐大數據。

這種多輪次、長上下文、短追加的智能體任務模式,帶來了新的問題。對于Transformer架構的模型而言,在處理新任務時,大部分所需上下文已在之前交互中計算過,可直接讀取緩存,即KV-Cache。KV-Cache命中率常高達95%以上,其作用如同人追劇時記住前面劇情,無需重復觀看就能理解新劇情。然而,強大的GPU處理幾百個token的新交互可能不到1毫秒,但獲取幾十萬token的KV-Cache數據卻需較長時間,就像大廚炒菜只需1秒,助手買菜卻要10秒。這使得智能體推理的最大瓶頸從算力轉變為KV-Cache數據的輸入輸出速度。

為提升推理性能,業內普遍采用“預填充-解碼分離”(PD分離)架構。該架構將GPU集群分為預填充引擎和解碼引擎兩部分。預填充引擎負責處理海量輸入文本,是計算密集型任務,擅長批量處理;解碼引擎負責逐字生成回答,對延遲敏感,但受內存限制。在這種架構下,預填充引擎需不斷從外部存儲加載海量KV-Cache數據,其存儲網卡常處于過飽和狀態,而解碼引擎的存儲網卡大部分時間卻閑置,導致高性能芯片集群硬件資源閑置,造成極大浪費。