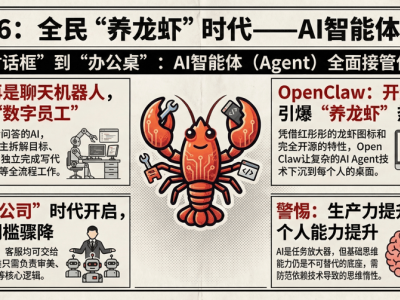

養(yǎng)龍蝦最近已經(jīng)登上各大平臺的熱門榜,各種消息鋪天蓋地,仿佛不接觸這最新技術(shù),你就會掉隊。對于普通人來說,事實(shí)真的如此嗎?

龍蝦是什么

為何還要去養(yǎng)它

龍蝦就是OpenClaw,它是一款開源的AI智能體框架,因圖標(biāo)有一只紅色龍蝦所以才被如此稱呼。

OpenClaw定位為AI智能體的骨架,也可以理解為操作系統(tǒng),本身并不帶有大模型,但具備將各類大模型及AI插件整合在一起協(xié)同作業(yè)。

目前市面上許多傳統(tǒng)的AI應(yīng)用或工具,基本上都是基于某一個方向,比如純文字、圖片生成、視頻生成等。

OpenClaw強(qiáng)大之處就在于,用戶的一句需求中可能需要調(diào)用多個不同領(lǐng)域的AI應(yīng)用,部署整合后的OpenClaw就能基于用戶指令直接完成多維的復(fù)雜需求。從點(diǎn)到點(diǎn)衍變成點(diǎn)到面。

現(xiàn)在來聊聊“養(yǎng)”該怎么理解。這里有兩層意思,第一層就是需要給OpenClaw裝配各種插件。各類AI插件應(yīng)用五花八門,也使得這只龍蝦完全基于使用者的個人工作需求來定制。

第二層意思就是用戶需要不斷的訓(xùn)練這只龍蝦,使它越來越強(qiáng),越來越了解你的習(xí)慣。就比如多次指令訓(xùn)練且對其布置任務(wù)后對產(chǎn)出的結(jié)果進(jìn)行評價和改進(jìn)方式。

如果探討OpenClaw是否強(qiáng)大?毋庸置疑,這是非常出色的AI技術(shù)升級。龍蝦具備非常高的上限,但為什么依然不推薦普通用戶盲目擁抱它?

算一筆賬

需求、費(fèi)用、投入產(chǎn)出比

先問2個問題:

1、你是否有足夠的需求讓自己一定要借助OpenClaw?

2、你愿意花多少時間教它做事?

對于大多數(shù)普通用戶來說,答案可能是:并沒有那么多剛需場景和精力。

如果說需求問題是有沒有必要養(yǎng),那費(fèi)用問題就是養(yǎng)不養(yǎng)得起。

現(xiàn)階段使用OpenClaw獲得比較好的體驗(yàn),或者是達(dá)到無需操心的自動化解決需求工作,基本上都要接入付費(fèi)模型的API才行。每次向你的龍蝦下達(dá)的指令,就代表要向模型廠商支付Token費(fèi)用,這才是養(yǎng)蝦人需要支付的“養(yǎng)殖成本”。

除此之外,如果用戶并不懂AI智能體或不具備一定的PC軟硬件知識,那么還需要加上如MacMini或PC硬件以及龍蝦安裝部署費(fèi)用。在還未確切的完成一個需求之前便已經(jīng)開始庫庫爆金幣了。

OpenClaw雖然本身是開源免費(fèi)的,但對于沒有技術(shù)背景的普通人來說,光是把它請進(jìn)門,就已經(jīng)是一道需要付費(fèi)跨越的門檻。

在二手交易平臺上,OpenClaw的遠(yuǎn)程安裝服務(wù)價格從幾十元到數(shù)百元不等,上門服務(wù)則普遍在500元至1500元之間。

除此之外,由于OpenClaw存在安全隱患,許多開發(fā)者建議不要在主力電腦上部署。這直接帶動了蘋果Macmini的熱銷,讓哪怕是二手設(shè)備也水漲船高。

OpenClaw的Token消耗量是普通大模型的數(shù)倍甚至上百倍。因?yàn)樗鼒?zhí)行任務(wù)時會進(jìn)行任務(wù)分解與編碼:搜資料、寫代碼、調(diào)試、優(yōu)化,每一步都要與大模型進(jìn)行多輪交互,每一步都在字面意思的燒錢。

目前,已有越來越多的受害者用戶在網(wǎng)上開始訴苦。用于支付Token的費(fèi)用已遠(yuǎn)大于實(shí)際產(chǎn)出的價值。

OpenClaw的使用群體

一類是那些工作中充斥著大量重復(fù)性操作的人,比如每天需要從十幾個網(wǎng)站收集數(shù)據(jù)、定時整理報表的分析師,或者需要批量處理文檔、同步多平臺信息的運(yùn)營人員。

另一類是具備一定技術(shù)背景的玩家。OpenClaw雖然號稱零門檻,但實(shí)際使用中,你需要面對命令行、配置文件、API密鑰,一個報錯信息可能就讓普通人卡住半天。

懂編程的人,可以把OpenClaw當(dāng)作一個可擴(kuò)展的工具箱,讓它幫自己寫代碼、調(diào)程序,甚至用它批量管理服務(wù)器。對這類群體來說,養(yǎng)蝦本身就是一種樂趣和探索。

當(dāng)然,也有一類純粹的技術(shù)愛好者或研究者,他們未必有明確的需求,但就是愿意為新技術(shù)交學(xué)費(fèi),想親手摸一摸AI能力的邊界。第一時間接觸前沿的AI場景化應(yīng)用。

說到底,當(dāng)下層出不窮的AI應(yīng)用本質(zhì)都是工具。工具的價值在于服務(wù)人,而不是讓人去服務(wù)工具。如果為了追熱點(diǎn),花大量時間、金錢和精力去折騰一個自己根本用不上的東西,那就本末倒置了。

真正的AI時代,不是比誰裝的工具多、誰追的熱點(diǎn)新,而是比誰能用最合適的工具解決自己的問題。如果現(xiàn)有的AI產(chǎn)品已經(jīng)能更高效的解決需求,那自然更加方便。

對于大部分普通人以及需求量來說,與其養(yǎng)蝦,不如直接使用市面成熟的AI產(chǎn)品。不論是用扣子進(jìn)階AI智能體,還是圖文、視頻生成的工作,都是更具性價比的選擇。

如果你在仔細(xì)算完前面那筆賬后,依然對AI自動化抱有濃厚的興趣,或者你本身就是一個需要頻繁折騰大模型的技術(shù)玩家,那么可以借助映眾RTX5060 Ti 8GB超級冰龍創(chuàng)建一個私人蝦塘了。

RTX5060 Ti 8GB超級冰龍搭載的第五代TensorCore能夠提供高達(dá)998AI TOPS的算力。這個數(shù)字可能有點(diǎn)抽象,換個說法:相當(dāng)于在個人PC里內(nèi)置了一個可以24小時不間斷運(yùn)行的助手。

以前你需要把數(shù)據(jù)傳到云端,讓大模型廠商的超級計算機(jī)幫你算,然后按Token付費(fèi)。現(xiàn)在,很多輕量級的AI模型可以直接在本地運(yùn)行,推理速度快,沒有API費(fèi)用,更不用擔(dān)心數(shù)據(jù)隱私泄露。

依托全新的NVIDIABlackwell架構(gòu),這張顯卡對AI的優(yōu)化是全方位的。它新增了對FP4精度的支持,這是一種更高效的運(yùn)算方式,能在幾乎不損失模型效果的前提下,大幅降低顯存占用和計算量,讓本地運(yùn)行大模型變得更加流暢。真正做到我的AI我做主。