在人工智能技術快速迭代的當下,大語言模型雖展現出強大的知識處理能力,但其龐大的體積與高昂的訓練成本始終是制約發展的瓶頸。特拉維夫大學布拉瓦特尼克計算機科學與人工智能學院的研究團隊近日提出突破性解決方案,通過創新性的知識蒸餾技術,在保持模型性能的同時顯著降低資源消耗,為AI訓練開辟了高效新路徑。

傳統知識蒸餾方法如同“填鴨式教育”,要求小型學生模型全面模仿大型教師模型的所有輸出。這種“全盤接收”的策略導致訓練效率低下,尤其在處理長文本時,學生模型需在每個位置分配計算資源,如同要求新手廚師同時掌握所有烹飪技巧。研究團隊發現,AI模型在不同位置的預測難度存在顯著差異,僅20%的關鍵位置貢獻了80%的學習價值,這為優化訓練策略提供了突破口。

研究團隊提出的SE-KD(學生熵引導知識蒸餾)方法,引入信息論中的“熵”概念作為學習信號。當學生模型對某個位置的預測熵值較高時,表明其對該位置的判斷存在不確定性,這正是需要教師模型重點指導的時刻。該方法通過動態識別這些高熵位置,構建起“按需學習”機制,使訓練過程從被動接受轉變為主動探索。實驗數據顯示,SE-KD在保持64.8%準確率的同時,將困惑度指標從7.3降至6.9,證明其能更精準地捕捉語言規律。

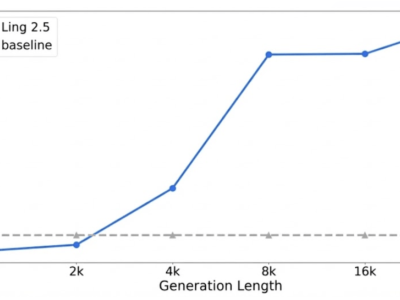

在三維選擇策略SE-KD3X的拓展應用中,研究團隊實現了訓練效率的質的飛躍。該方法通過位置選擇、類別選擇和樣本選擇的協同優化,構建起立體化訓練框架:位置選擇聚焦高熵區域,類別選擇僅關注概率排名前5%的候選詞匯,樣本選擇則優先處理平均熵值最高的訓練數據。這種多維篩選機制使80M代幣訓練的總時間減少70%,內存占用降低28.1%,存儲需求更是壓縮至傳統方法的2%。特別在在線策略蒸餾場景中,結合樣本選擇的SE-KD方法將模型指令跟隨能力提升至21.4%,超越傳統方法的20.5%。

技術實現層面,研究團隊開發了兩項關鍵優化:選擇性語言模型頭部通過僅在被選位置計算完整概率分布,避免無效計算;分塊熵計算將大型張量分解為獨立處理單元,有效防止內存溢出。這些創新使模型在處理長序列時,既能保持預測精度,又將教師模型緩存需求從10000TB壓縮至3.84TB,為移動端部署大型語言模型提供了可能。

實驗驗證覆蓋多個基準測試集,包括常識推理(HellaSwag)、物理直覺(PIQA)和閱讀理解(Arc-E)等任務。在通用知識蒸餾場景中,使用Qwen3-8B作為教師模型、Qwen3-1.7B作為學生模型的組合,SE-KD方法在8000萬代幣訓練中展現出顯著優勢。值得注意的是,在數學推理任務(GSM8K)中,傳統方法仍保持領先,這提示不同任務可能需要定制化優化策略。研究團隊特別強調,樣本選擇策略在在線學習場景中表現突出,其71.2%的準確率超越傳統方法的70.6%,證明動態調整訓練重點的有效性。

這項研究對AI技術落地具有重要啟示。在移動設備領域,高效訓練方法可使語音助手、圖像識別等功能在本地設備流暢運行,減少對云端計算的依賴。教育科技行業可借鑒“按需學習”理念,開發能自動識別學生知識盲點的智能輔導系統。對于資源有限的中小企業,70%的訓練成本降低和80%的存儲需求縮減,意味著定制化AI模型開發不再是大公司的專利。環境效益同樣顯著,訓練效率的提升直接減少電力消耗,符合“綠色AI”的發展趨勢。

研究團隊指出,當前成果僅是階段性突破,未來工作將探索特征層面的選擇性學習,并研究如何將該方法與聯邦學習、持續學習等前沿技術結合。在數學推理等特定任務中表現出的性能差異,也提示需要開發任務自適應的選擇策略。隨著技術不斷完善,這種“精準教學”模式有望重塑AI訓練范式,推動智能技術向更高效、更普惠的方向發展。對技術細節感興趣的讀者,可通過arXiv編號2602.01395v1查閱完整論文。