在實時數字人賽道,開發者們曾長期面臨一個困擾:追求高畫質就需要具備昂貴的 H800 集群,追求低成本就得忍受“面癱”和畫面崩壞。

為解決這一問題,繼開源 14B 的實時數字人生成模型SoulX-FlashTalk 之后,近日,Soul App AI團隊(Soul AI Lab)推出了SoulX-FlashHead。這款1.3B參數的輕量化模型,能夠在單張消費級顯卡( RTX 4090 )上跑出96FPS的工業級速度,同時實現高質量畫質,為行業提供新的實時數字人方案。

目前,SoulX-FlashHead 的權重與代碼已全面開放:

論文:https://www.arxiv.org/pdf/2602.07449

項目:https://soul-ailab.github.io/soulx-flashhead/

代碼:https://github.com/Soul-AILab/SoulX-FlashHead

模型:https://huggingface.co/Soul-AILab/SoulX-FlashHead-1_3B

數據集:https://huggingface.co/datasets/Soul-AILab/VividHead

SoulX-FlashHead核心亮點:

不僅是實時,更是“算力自由”

在消費級顯卡上,SoulX-FlashHead 的表現:

·Lite版本(高速率):單卡4090推理幀率可達96FPS,僅需6.4G顯存,最高支持3路并發,讓實時數字人模型真正走到了消費級終端上。

·Pro版本(高畫質):單卡5090推理幀率16.8FPS,雙卡可實時(25fps+),FID(視覺質量指標)和Lip-sync(唇形一致指標)在benchmark上達到了SOTA,甚至超過了更大參數量的模型,解決了“小模型沒好畫質”的行業痛點。

原理介紹

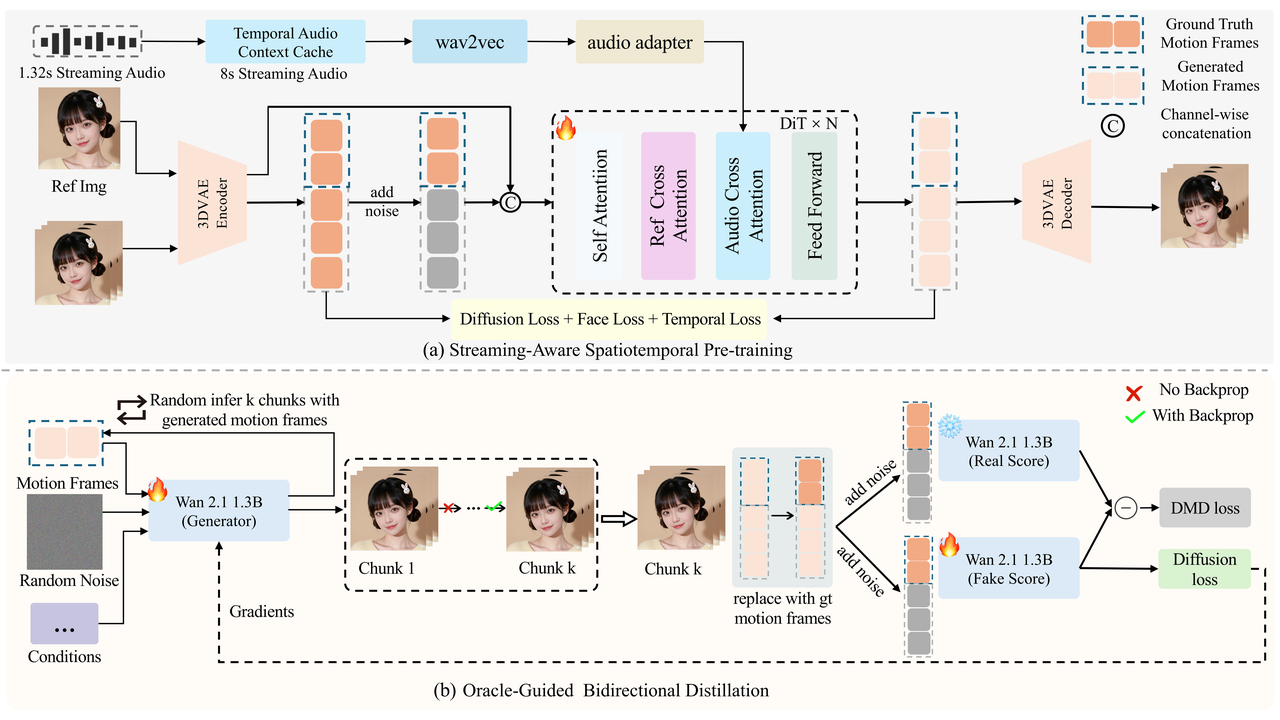

如何讓 1.3B 模型“以小博大”?SoulX-FlashHead創新引入了:

訓練“先知”:雙向蒸餾機制 (Oracle-Guided Distillation)

長視頻生成的“身份漂移”一直是行業痛點。SoulX-FlashHead引入了“上帝視角”教師模型,利用 Ground Truth 作為先知錨點進行強約束。

效果: 像給模型裝了校準器,無論視頻多長,人物特征始終穩定。

8秒記憶:時序音頻上下文緩存 (TACC)

流式生成中,音頻切片太短會導致口型抖動。

創新: 強制模型緩存 8秒 歷史音頻特征,補償上下文缺失。

體驗: 解決“嘴瓢”和“對不上號”問題,開播即進入理想狀態。

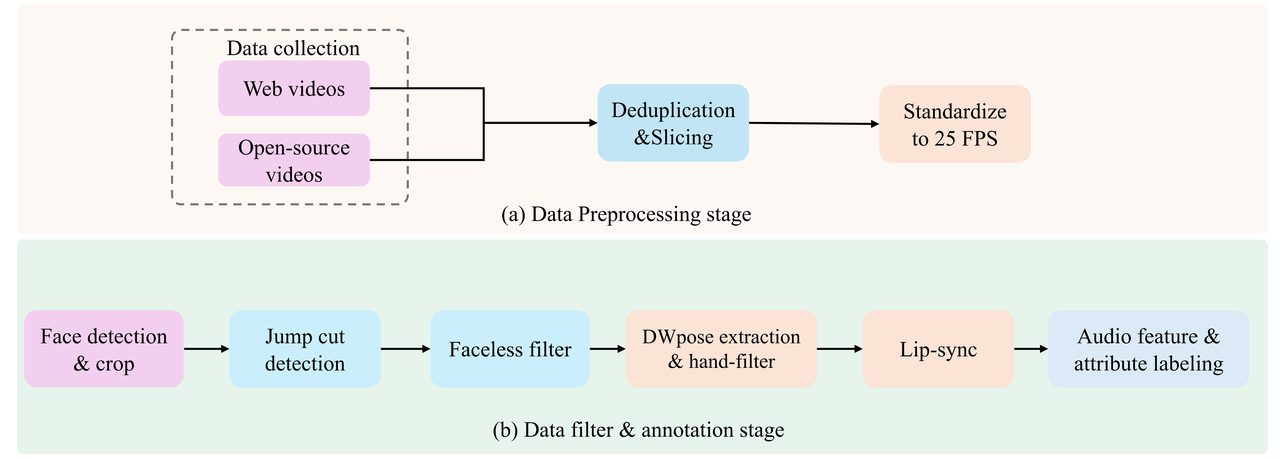

高質量數據底座:自研 VividHead 數據集

從 10,000+ 小時素材中精煉出 782 小時高質量音畫數據:

嚴苛篩選: 經過切分、DWpose 關鍵點、唇形一致分數過濾等多個處理步驟,為模型提供了最純凈的“養料”。

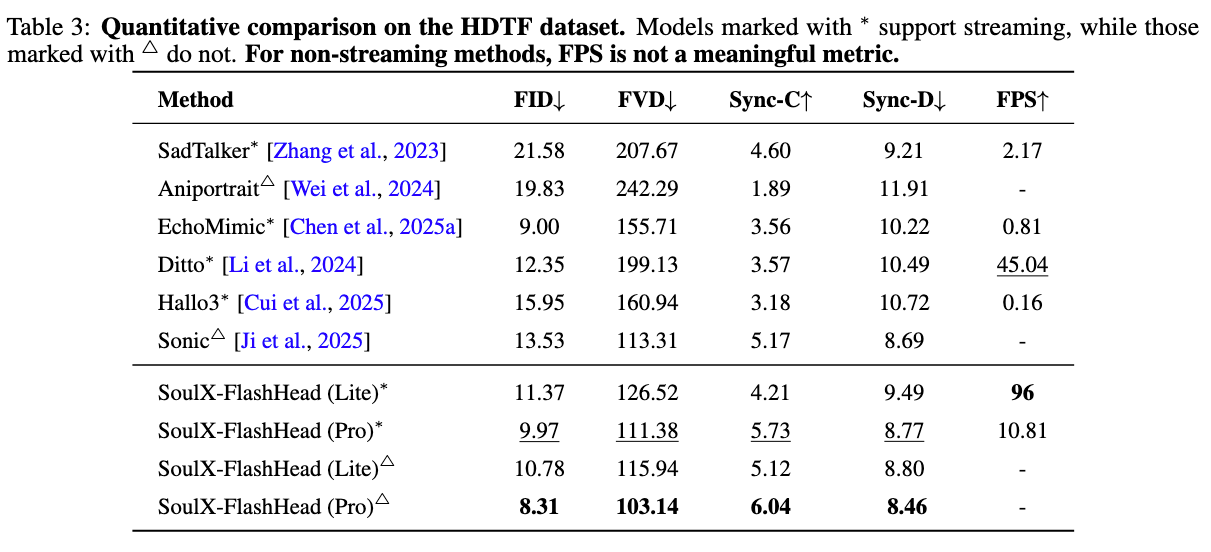

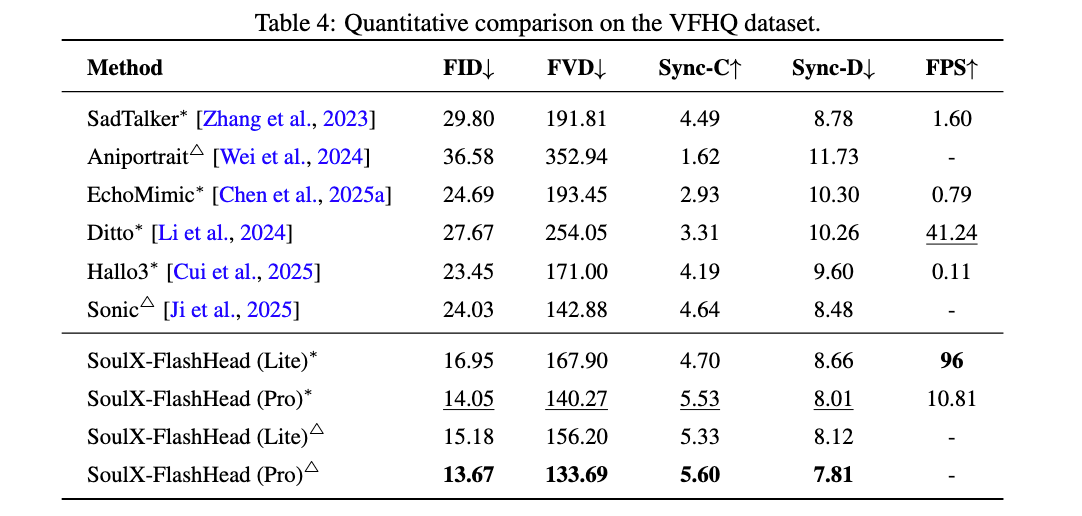

客觀表現

在 HDTF 與 VFHQ 兩大權威數據集的實測中,SoulX-FlashHead 展現了出色的表現:

畫質新標桿:在高清視頻(HDTF)評測中,Pro 版本以 8.31 (FID) 和 103.14 (FVD) 的成績刷新紀錄,視覺細膩度超過 一些“大參數”模型。

口型精準捕捉:面對野外復雜場景(VFHQ),憑借獨創的“時序音頻上下文緩存”策略,其 Sync-C 得分高達 5.60,大幅領先此前相關工作,解決對不上口型的尷尬。

速度“快”:僅憑 1.3B 的輕量化體量,Lite 版本在單張 RTX 4090 上跑出了 96 FPS 的吞吐量。這不僅是實時基準(25 FPS)的 近4倍,推理效率更是行業同類主流模型的 100倍以上。

應用場景:

“人人可用”的數字人技術

今年1月,Soul AI Lab開源了實時數字人生成模型SoulX-FlashTalk,能夠實現0.87s亞秒級超低延時、32FPS高幀率,并支持超長視頻穩定生成。

對比SoulX-FlashTalk,SoulX-FlashHead的價值在于,將高保真技術進一步從“算力機房”解放到了“個人工作站”,讓更廣泛的場景應用成為可能:

·7x24h矩陣直播:個人主播用一臺游戲 PC,即可搭建高保真電商直播間。

·游戲NPC引擎:1.3B 體積極易集成,NPC 毫秒級響應,且不搶占核心渲染資源。

·AI一對一外教:支持 15 種語言,實時將音頻轉化為生動的教學畫面。