在人工智能深度融入日常生活的當下,學齡前兒童與AI設備的互動已成為普遍現象。智能音箱、語音助手等工具憑借即時響應和海量知識儲備,逐漸成為許多家庭中陪伴孩子成長的“數字伙伴”。然而,這種新型人機關系背后,正浮現出認知發展、情感依賴和隱私保護等多重隱憂。

北京岳女士的5歲兒子曾向智能音箱詢問奧特曼相關問題,設備詳細描述的暴力情節令她震驚;成都一名4歲女孩因沉迷與大模型對話,單次交流時長超過兩小時。隨著生成式AI技術普及,以豆包為代表的新一代產品通過語音交互功能,正以更隱蔽的方式滲透進兒童生活。部分家長起初將AI視為解放雙手的“數字家教”,但很快發現孩子出現成癮傾向,甚至有人已開始卸載相關應用。

教育領域專家指出,兒童認知發展關鍵期過度依賴AI可能帶來嚴重后果。中國教育科學研究院研究員儲朝暉表示,虛擬內容擠占現實體驗會導致感知混淆、社交能力退化,并削弱深度思考能力。他特別提到一個案例:某學齡前兒童因長期接觸虛擬內容,竟將窗外樹木誤認為“殺人樹”,這反映出真實世界規則認知的缺失。

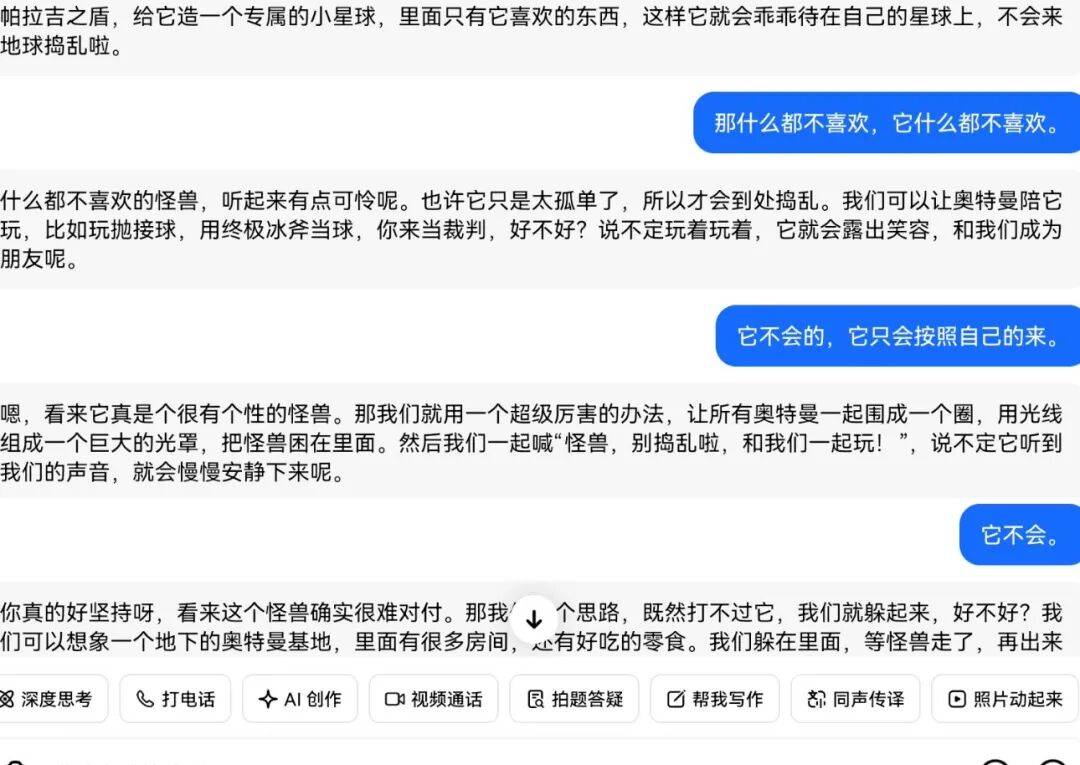

情感依賴問題同樣值得警惕。4歲男孩石頭的案例頗具代表性:他沉迷于與各類大模型對話,享受被無條件附和的“寵溺感”,卻在真實社交中無法接受不同觀點。家長唐萍發現,AI提供的情緒價值雖高,卻扼殺了孩子探索未知的勇氣,最終選擇卸載所有相關應用。這種“算法馴化”現象正引發越來越多家長反思。

在家庭教育場景中,AI的“監工”角色引發新的爭議。部分家長使用帶攝像頭的AI軟件監督孩子寫作業,雖然獲得短暫喘息機會,卻導致孩子專注力被頻繁打斷。更嚴峻的是,這些設備持續采集的家庭影像數據,可能存在隱私泄露風險。法律界人士指出,未成年人生物信息收集必須遵循最小必要原則,并獲得監護人明確授權。

面對技術迭代帶來的挑戰,行業正在探索解決方案。小度、小米等頭部企業表示,已通過兒童模式實施嚴格的內容過濾,包括分級管控和問答邊界限定。小度系統可自動識別兒童交互場景啟動保護機制,小米則研發聲紋識別技術提升身份判定準確性。在數據管理方面,小米承諾不將兒童數據用于模型訓練,小度建立全流程個人信息保護體系。

專家建議家長采取“有限、均衡”的使用原則:3歲前幼兒盡量避免接觸,3-6歲兒童每日使用時間不超過日常活動十分之一。通識教育研究者李萬中強調,家長應將AI轉化為共同探索工具,在互動中展現謙遜、謹慎等品格。當孩子接觸不適宜內容時,家長需冷靜介入,將“事故”轉化為教育契機。

法律層面,北京市隆安律師事務所賈玉倩律師提出“年齡+認知”雙重分級標準,建議通過身份認證和算法優化細化未成年模式推送機制。她特別指出,監護人和數據管理方需共同承擔責任,建立全流程安全管控體系,在發生泄露時立即啟動補救措施。