過去幾天,硅谷上演了一出堪比《黑鏡》的倫理大戲。

前腳Anthropic剛剛立起“數字貞節牌坊”,發誓不搞“大范圍數字監控”和“全自主武器”,公開與美國軍方唱反調。

后腳,曾經的非營利組織OpenAI,就火速官宣與國防部首席數字與人工智能辦公室(CDAO)達成合作,合同最高金額達2億美元。

一夜之間,兩者的口碑迅速滑向兩個極端。

一個成了浪子回頭的圣人,一個成為千夫所指、毫無下限的戰爭販子。

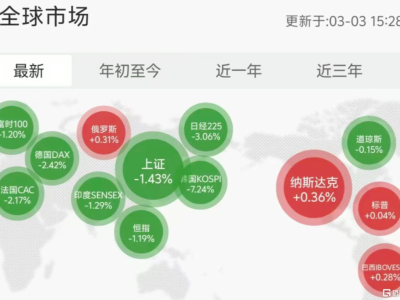

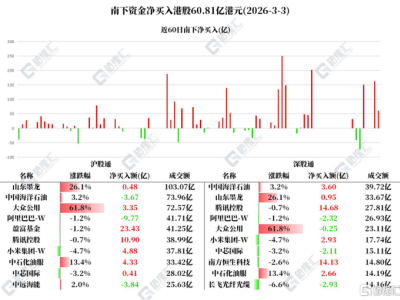

2月28日,OpenAI宣布與國防部合作當天,卸載量較前一天暴增295%。

截至3月3日中午,ChatGPT美國區累計卸載量已突破300萬,一星評價暴漲775%,活躍用戶流失超120萬。

反觀Claude,下載量暴漲51%,直接沖上美國App Store榜首。

美國網民似乎正集體對邪惡進行審判。

但大眾畢竟是盲目、甚至愚蠢的,很容易被輿論帶節奏。

作為一個旁觀者,一名投資者,我們必然要冷靜得多。

Anthropic為什么突然硬氣?OpenAI為什么突然糊涂?

世界上從來沒有純粹的黑與白。

01?“圣人”溢價

Anthropic肯定不是什么圣人。

它是第一家在美國政府保密網絡中部署前沿AI模型的公司,也是第一家為國家安全客戶提供定制模型的公司,廣泛參與到戰爭部的情報分析、作戰規劃、網絡行動等核心任務。

為了更多訂單,它并不排斥將AI應用于軍事。

只不過這次,軍方提出了兩個“越界要求”。

第一,大規模國內監控。

Anthropic明確表示,支持針對境外的情報工作,但絕不允許Claude用于對美國公民的大規模監控。

有個詞叫“數字畫像拼接”,簡單來說,就是政府可以不用搜查令、從公開渠道購買美國公民的行蹤、網頁瀏覽記錄、社交關系等零散數據,一旦AI介入,就能自動把這些零散數據拼接成一個人的完整數字畫像。

屆時,每個人的一舉一動都將被嚴密監控。

這不是簡單的隱私問題,而是對公民自由的系統性威脅,天然站在所有人的對立面。

第二,全自主武器。

即把人類完全移出決策環節,由AI自行選擇目標、發起攻擊。

有別于現在那些雖然有AI輔助、但最終的攻擊決策還是由人類做出“部分自主武器”。

為什么要拒絕前者呢?

最大的原因,是現在的AI系統不夠完善,根本無法做到“全自主”,有很大概率出錯。

而一旦出錯,傷亡的就是美國士兵和無辜平民。

屆時,Anthropic要承擔多大的輿論壓力?

顯然,這兩個要求的任何一個,都是把人架在火上烤。

一旦答應了,以后除了美國軍方,不僅民間會自發抵制它,更重要的B端也將被堵死。

從市場策略的角度來看,這叫“道德護城河”。

根據Gartner發布的《2025年企業AI采用報告》,超68%的500強企業在部署大模型時,將“數據隱私與合規性”列為第一考量,遠高于“模型性能”。

也就是說,Anthropic在這個節點高舉道德大旗,并非因為他們真的是圣人,更可能是在爭奪最肥的那塊肉:企業級合規市場。

這是很淺顯的道理,大型跨國銀行或醫療機構敢用一個在民間臭名昭著的模型來處理客戶數據嗎?

大概率不敢。

Anthropic拒絕美國軍方,實際上是在向華爾街和歐洲監管機構(特別是歐盟的AI Act)遞投名狀。

歐盟AI法案已于2026年1月1日正式生效,2月進入全面執行階段,其中明確規定,“實時遠程生物識別(公共場所)、社會信用評分、全自主武器”等屬于禁止類AI,違規企業將被處以全球年營業額6%的罰款。

Anthropic的合規布局,等于順應全球AI監管的趨勢,哪怕拒絕美國軍方的合作,它也能在全球市場獲得認可。

主要地區已落地關于AI的監管,來源:財通證券

根據Gartner 2026年2月的報告,Anthropic在“倫理合規”方面的用戶滿意度高達4.8星,遠超行業平均的3.6星。

雖然短期內損失了國防部這個8000億美元的大客戶,但卻鎖死了萬億級的民用合規市場。

所以Anthropic才突然浪子回頭,發誓要“做個好人”。

但是,它還是留了條后路:如果軍方要換供應商,會配合平穩過渡,確保正在進行的軍事行動不受影響。

這再一次說明,Anthropic并非什么圣人,只是懂得趨利避害的企業而已。

當然與OpenAI相比,這的確是“有底線”的表現。

那OpenAI又為什么丟掉底線?

02?無奈之舉?

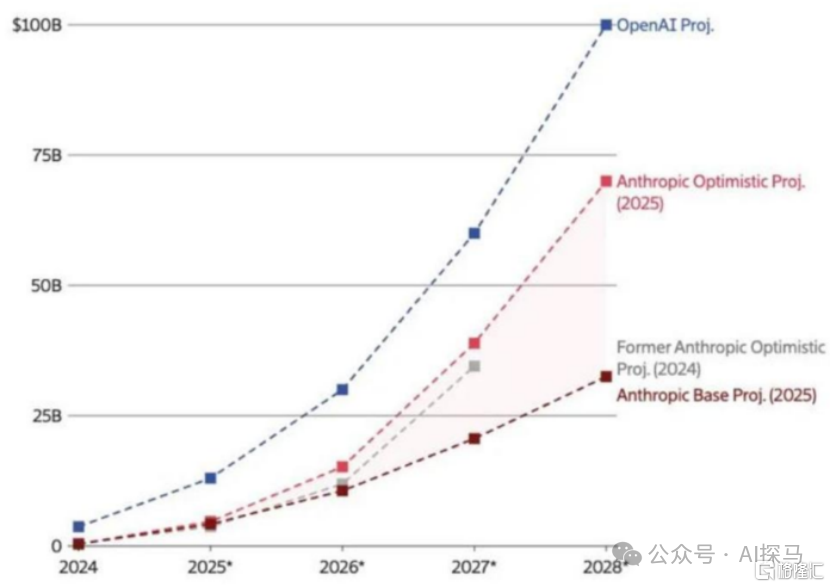

首先,兩家公司的定位,從一開始就不一樣;其次,OpenAI遠比Anthropic缺錢。

Anthropic的戰略核心是“AI安全+合規差異化”,目標是成為“全球最可靠的AI公司”。

根據其2025年的財報,公司每年在AI倫理和安全上的投入,占總營收的23%,遠高于行業平均水平的12%。

同時,短期內,它并沒有非常大的資金壓力。

根據Crunchbase的行業融資報告,Anthropic于2025年完成了一輪100億美元的融資。

關鍵點是什么呢?

谷歌、亞馬遜等投資方明確表示,支持Anthropic的“AI倫理底線”,不要求其“短期盈利”。

客戶更是如此。

2025年,Anthropic的營收達到45億美元,同比增長120%,其中B端占比達到60%。這些客戶的付費意愿高,粘性強,而且不會要求Anthropic突破倫理底線。

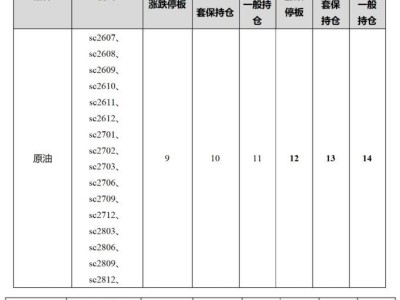

Anthropic收入中60%+來自API,來源:中金公司

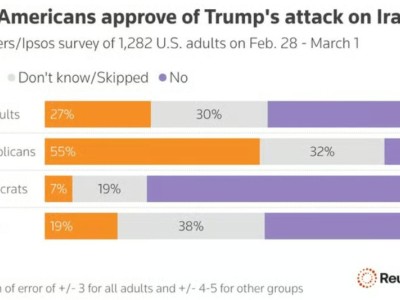

反觀OpenAI,其戰略核心是“規模變現+政企綁定”,目標是成為“全球最大的AI公司”。

怎么才能大?

無非是快速盈利、快速擴張,其它的都是次要的。

但OpenAI現在最大的困境就是,雖然賺錢速度快(2025年營收180億美元),但燒錢速度更快。

據The Information披露的數據,OpenAI在2025年的訓練成本和推理成本預計達到70億美元,算力基礎設施的資本支出更是個無底洞。

2025年,公司全年虧損28億美元,雖然虧損幅度較2024年收窄,但距離盈利還有很大的距離。

偏偏在這種時候,最大的投資方微軟卻要求OpenAI在2027年前必須實現盈利,否則將減少甚至停止投資。

如此巨大的壓力,導致OpenAI不得不急功近利。

哪里有“利”?

OpenAI與Anthropic收入曲線,來源:The Information

根據FutureSearch 2026年2月的報告,OpenAI的年度經常性收入雖然高達34億美元,但其中55%來自ChatGPT的C端會員付費,B端API收入僅占15%。

更關鍵的是,根據SimilarWeb的數據,2026年1月,ChatGPT的C端活躍用戶環比增長僅2.3%。

這意味著C端增長現階段基本見頂了。

極端的結構失衡,讓OpenAI急于拓展B端市場,尤其是政企市場(毛利高達68%)。

這方面的最大金主是誰?

毫無疑問是美國國防部。

2025財年,美國國防部的預算申請高達8498億美元,其中僅用于RDT&E的預算就高達1432億美元,且以每年18%的速度高速增長。

同時,這里還有一個隱形訴求。

OpenAI 2025年收入中近半來自C端,來源:中金公司

OpenAI計劃在2026年底啟動IPO,估值目標是1萬億美元。而要實現這個估值,獲得美國政府的背書至關重要。

和國防部達成合作,相當于貼上了“官方認可”的標簽,這在IPO估值中是很重要的加分項。

而早在一年前,OpenAI就悄悄從使用條款中刪除了“禁止用于軍事和戰爭”的字樣,如今這只靴子只能說終于落地了。

所以,OpenAI這次選擇“拿國防部的錢來補貼民用AGI的研發”,是早有預謀的,在邏輯上也說得通。

但落地在實際中,這毫無疑問是一場災難。

03?三重暴擊

奧特曼顯然事先低估了用戶的敏感度。

根據Sensor Tower和SimilarWeb的聯合數據,截至3月3日13時,ChatGPT美國區的活躍用戶較2月28日減少了120萬,流失率達到17.6%。

7天留存率也從68%跌到42%,這意味著很多用戶卸載后,就再也不會回來了。

最傷的是,OpenAI的品牌好感度從72分(滿分100)跌到35分,低于谷歌、Anthropic等同行,甚至被貼上了“戰爭販子”的標簽。

根據Brandwatch?的最新輿情預測,OpenAI的負面輿情峰值將持續至3月中旬,至少需要3-6個月才能逐漸平息,而且需要投入不低于8億美元的公關費用,才能初步挽回用戶信任。

這筆錢,遠高于拿到的國防部訂單。

更麻煩的是,據美國司法部3月3日公告,已有12名議員聯合提出,將對OpenAI與國防部的合作啟動專項倫理審查,審查將于3月10日正式啟動。

一旦查實違規,OpenAI將面臨巨額罰款,甚至可能被終止合作、納入國防合作黑名單。

歐盟AI辦公室也發布聲明,將同步核查OpenAI的合作內容,是否違反歐盟AI法案中“禁止全自主武器相關AI研發”條款。

一旦查實違規,OpenAI將面臨全球年營業額6%的罰款,按照2025年180億美元營收算,罰金高達10.8億美元。

而且,可能被逐出歐盟市場,這對OpenAI的全球擴張,是致命的打擊。

基于這些風險,B端客戶也開始動搖了。

據Forrester?的最新調研數據,有37%的美國政企客戶,表示“將重新評估與OpenAI的合作”;12%的客戶,已經明確表示“將終止與OpenAI的合作”,轉而選擇Anthropic、谷歌等“倫理合規”的AI公司。

上文也說了,政企客戶是OpenAI未來的增長核心,一旦這些客戶流失,其盈利的壓力可能比現在更大。

按照當前的流失速度,預計OpenAI 2026年Q1的企業業務營收,將環比下降23%,損失超過5億美元。

損失的錢,同樣遠超這次拿到的國防部訂單。

除此之外,更有一點致命的隱患不得不說。

據Levels.fyi的數據,在硅谷頂級AI研究員的年薪在80萬到150萬美元之間。

這些人大多不缺錢,他們缺的是“信仰”。

OpenAI的這次舉動,不僅僅是自損品牌形象,更是對這些技術人才信仰的褻瀆。

這波輿論風暴中,最扎心的一刀來自OpenAI內部,年僅19歲、被視為核心算法團隊未來的天才工程師Potato Dog,因反對與國防部合作憤然辭職,轉頭就加入了Anthropic。

他在離職推文中的大概意思是:“我加入是為了造神,不是為了造終結者。”

再看LinkedIn的職場數據,3月1日-3日,OpenAI的員工離職率較平時暴漲189%,其中倫理團隊、AI安全團隊的離職率高達37%,大部分人的離職原因都是“與公司價值觀不符”“無法接受AI用于軍事用途”。

據Blind上的匿名調查,OpenAI的內部士氣指數已下降了約15%;人才獲取成本則飆升,未來要招到同樣水平的天才,可能需要支付20%-30%的溢價。

技術的護城河本質上就是人才儲備。

這些人的離去,對OpenAI的長期發展,毫無疑問是致命打擊。

因為AI產品具有極強的替代性。

看看目前市面上的競品:

Claude,主打安全,現在道德光環加身;

Gemini,雖然有這樣那樣的問題,但至少捆綁在安卓生態里;

Llama 3,開源,不想被監控就自己部署……

如果OpenAI不能及時挽回用戶和員工信任,在對手突飛猛進的時候突然慢下來,其市場份額只會被一點點瓜分。

這就不僅是公關危機了,更是估值危機。(全文完)