近日,一場聚焦開源數據集的盛會在上海漕河涇會議中心拉開帷幕。此次“開放原子‘園區行’——開源數據集專場”活動意義非凡,不僅見證了“具身智能開源數據集社區”的正式啟動,還迎來了全球首個OpenLET全身運控數據集的首發。

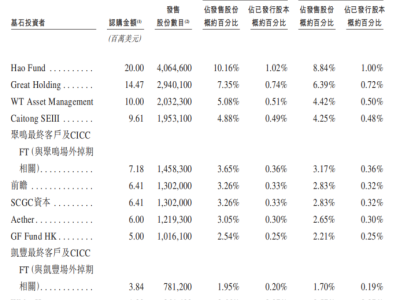

緊接著,“開放原子具身智能開源數據集社區”宣告成立。這一社區由開放原子開源基金會發起,樂聚機器人牽頭建設,并聯合螞蟻靈波、庫帕思、上海交通大學、哈爾濱工業大學、同濟大學、宇樹、具識智能、具腦磐石、無問智行等眾多核心單位共同打造。作為國家級平臺發起的首個具身智能開源數據集社區,它致力于成為全球具身智能領域極具影響力和吸引力的真實數據資源樞紐與協作創新平臺。

活動現場,OpenLET“觸覺靈巧操作 + 全身運動”數據集在AtomGit人工智能開源社區全球首發。這一數據集具有開創性意義,它是全球首個融合觸覺靈巧操作與全身高動態運動的多模態具身智能數據集開源項目,同時也是國內首次開源全尺寸人形機器人全身運控多模態真機數據,成功填補了行業在該領域的空白。

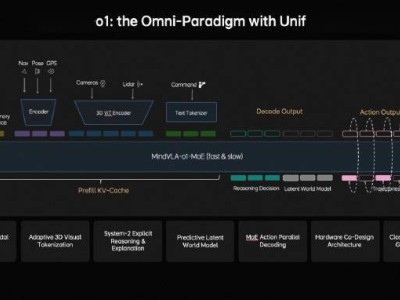

該數據集包含兩大核心亮點板塊。其中,LET靈巧操作數據提供了6×12×10指尖壓力矩陣的觸覺陣列數據、精度達±0.5%的六維力數據以及高分辨率的RGB - D視覺數據,實現了“視覺 - 力觸 - 動作”全鏈路的同步對齊,能夠精準捕捉機器人操作的全維度細節。LET全身運控數據則覆蓋了41個關節的精細控制信號,將任務維度從基礎行走站立拓展至深度下蹲、彎腰等高難度全身聯動任務,在動作節奏、平衡維持及交互順應性上展現出高度擬人的表現。