OpenAI首席科學家Jakub Pachocki在近期訪談中透露,公司正集中資源推進"AI研究員"項目,計劃在未來五年內(nèi)構建具備自主科研能力的多智能體系統(tǒng)。該平臺旨在通過自動化流程處理數(shù)學、物理、生物等領域的復雜問題,減少人工干預需求。根據(jù)技術路線圖,OpenAI將于2026年推出初級版本"自動化研究助手",兩年后升級為完整科研系統(tǒng)。

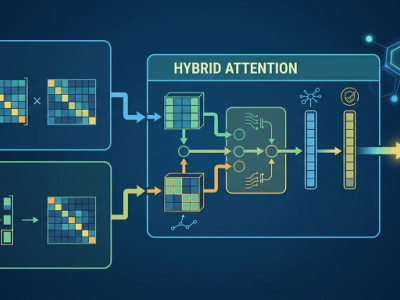

研發(fā)團隊以Codex模型為基礎進行迭代開發(fā),該工具已展現(xiàn)出代碼生成、文檔解析和任務分解能力。技術人員在日常工作中驗證了這類系統(tǒng)的實用性,通過組合推理模型與智能體架構,顯著提升了長時間任務的穩(wěn)定性。最新訓練方法引入逐步推理和錯誤修正機制,使模型在處理多步驟數(shù)學問題時表現(xiàn)出更強的邏輯連貫性。

技術演進呈現(xiàn)顯著特征:從GPT-3到GPT-4的迭代過程中,模型獨立工作時間延長了3.7倍。研究人員通過強化學習框架,使系統(tǒng)在完成編程任務時能自動調(diào)整策略,這種能力遷移為科研場景奠定了基礎。目前實驗顯示,系統(tǒng)在理論物理和計算化學領域的初步應用中,已能完成20%的基礎研究工作。

學術界對項目前景保持審慎態(tài)度。Allen Institute專家指出,復雜任務中的誤差傳遞仍是主要障礙,當前模型在處理跨學科問題時,錯誤率隨步驟增加呈指數(shù)級上升。例如在生物信息學分析中,系統(tǒng)在第五步推理時的準確率較首步下降42%。這種局限性要求研發(fā)團隊重新設計驗證機制。

安全架構方面,OpenAI創(chuàng)新性地引入"雙重監(jiān)督模型",主系統(tǒng)推理過程將被同步記錄并由獨立模型審核。所有高風險操作將在物理隔離的云端環(huán)境中執(zhí)行,數(shù)據(jù)傳輸采用量子加密通道。公司安全主管強調(diào),這種設計能將意外風險發(fā)生概率控制在每百萬次操作0.3次以內(nèi)。

潛在風險引發(fā)治理討論。專家警告,自動化科研系統(tǒng)可能加劇技術壟斷,當前全球83%的AI研究資源集中在五家科技企業(yè)。Pachocki承認,系統(tǒng)可能被用于生成危險化學品配方或軍事技術文檔,這需要建立跨國監(jiān)管協(xié)議。歐盟已啟動相關立法程序,要求科研AI系統(tǒng)必須保留人工干預接口。

市場競爭呈現(xiàn)新態(tài)勢。Anthropic本周公布了類似項目的進展,其"Claude-Science"系統(tǒng)在數(shù)學定理證明測試中取得突破。Google DeepMind則選擇與頂尖實驗室合作,通過共享數(shù)據(jù)集加速模型訓練。行業(yè)分析師認為,自動化科研系統(tǒng)的競爭將重塑AI產(chǎn)業(yè)格局,預計到2027年相關市場規(guī)模將突破200億美元。