在人工智能領域,大型語言模型的發展正面臨一個關鍵挑戰:隨著網絡層數的不斷增加,模型在處理早期信息時會出現明顯的衰減現象,就像人類在長對話中逐漸遺忘開頭的重要內容。針對這一難題,華中科技大學電子信息與通信學院與字節跳動Seed團隊聯合研發出一種創新的深度混合注意力機制(MoDA),為構建更強大的AI系統提供了新的技術路徑。

研究團隊深入分析了現有解決方案的局限性。傳統的殘差連接方法雖然能夠幫助訓練更深層的網絡,但會將所有歷史信息壓縮成單一的記憶線索,導致重要信息在傳遞過程中逐漸丟失。而密集連接方法雖然能夠完整保留歷史信息,卻需要承受內存和計算開銷呈平方級增長的代價,這在大型模型中難以實際應用。針對這些痛點,MoDA機制創造性地讓每個網絡層既能處理當前序列信息,又能有選擇地回顧之前所有層的關鍵信息。

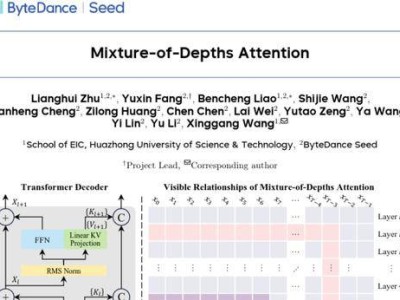

MoDA的核心創新在于將序列級注意力和深度級注意力融合到統一的softmax操作中。具體實現上,每個注意力頭不僅關注當前層的序列鍵值對,還能訪問所有前置層的深度鍵值對。這種設計使模型能夠根據任務需求,自適應地分配注意力權重到序列信息和深度信息上。研究團隊通過精心設計的掩碼機制,確保了信息訪問的因果性約束,同時開發了輕量級的鍵值投影方法,使深度流中既包含注意力層信息,也包含前饋網絡層信息。

在效率優化方面,研究團隊取得了顯著突破。他們提出的塊感知深度鍵值布局將查詢分成塊,每個塊只訪問對應的局部深度鍵值區域,大幅減少了不必要內存傳輸。通過分組查詢注意力特性設計的組感知計算方法,進一步將有效深度利用率提升至新水平。這些創新使MoDA在64K序列長度下的運行效率達到FlashAttention-2的97.3%,同時將參數復雜度優化至最低水平。

實驗數據顯示,MoDA在多個評估維度上表現出色。在1.5B參數規模的模型測試中,相比基線模型在10個驗證基準上平均困惑度降低0.2,在10個下游任務上平均性能提升2.11%,而計算開銷僅增加3.7%。注意力可視化分析揭示,模型確實在深度鍵值塊上分配了持續的注意力權重,特別是在中間層和后期層。不同類型的注意力頭展現出互補的工作模式,共同處理局部序列依賴和全局深度信息。

研究還發現,MoDA在不同深度配置下均能穩定提升性能。在48層深層模型測試中,后歸一化配置從深度鍵值中獲得的收益比預歸一化配置更大,驗證損失改善達0.0409。效率優化實驗表明,三種核心實現策略的結合相比基礎實現實現了約1458倍的端到端加速,充分證明了硬件感知設計的重要性。

針對工業化部署挑戰,研究團隊提出了有界深度鍵值槽緩存的創新思路。該方案使用固定大小的深度鍵值槽緩沖區,通過動態選擇或滑動窗口策略管理深度記憶,將內存和帶寬開銷從深度依賴擴展轉變為槽依賴擴展。這種設計不僅為融合內核實現提供了穩定的張量形狀,還為超大規模模型訓練中的內存管理提供了新的解決方案。