螞蟻集團旗下具身智能公司螞蟻靈波科技近日宣布,其自主研發(fā)的LingBot-VLA具身大模型及后訓練代碼已全面開源。該模型已與星海圖、松靈、樂聚等機器人廠商完成適配,驗證了跨不同構型機器人的遷移能力,為行業(yè)提供了可復用的技術框架。

在訓練效率方面,螞蟻靈波科技構建的后訓練工具鏈表現(xiàn)突出。在8卡GPU配置下,該工具鏈實現(xiàn)單卡每秒處理261個樣本的吞吐量,訓練效率較StarVLA、OpenPI等主流框架提升1.5至2.8倍,顯著降低了數(shù)據(jù)與算力成本。這一突破為大規(guī)模模型訓練提供了更經(jīng)濟的解決方案。

基于海量真實世界數(shù)據(jù)的預訓練研究,螞蟻靈波科技首次系統(tǒng)探索了VLA模型性能隨數(shù)據(jù)規(guī)模增長的規(guī)律。實驗顯示,當預訓練數(shù)據(jù)從3000小時逐步擴展至20000小時,模型在下游任務的成功率持續(xù)顯著提升。值得注意的是,即使數(shù)據(jù)量達到20000小時,模型性能仍未觸及瓶頸,表明其仍具備通過增加數(shù)據(jù)量進一步提升性能的潛力。

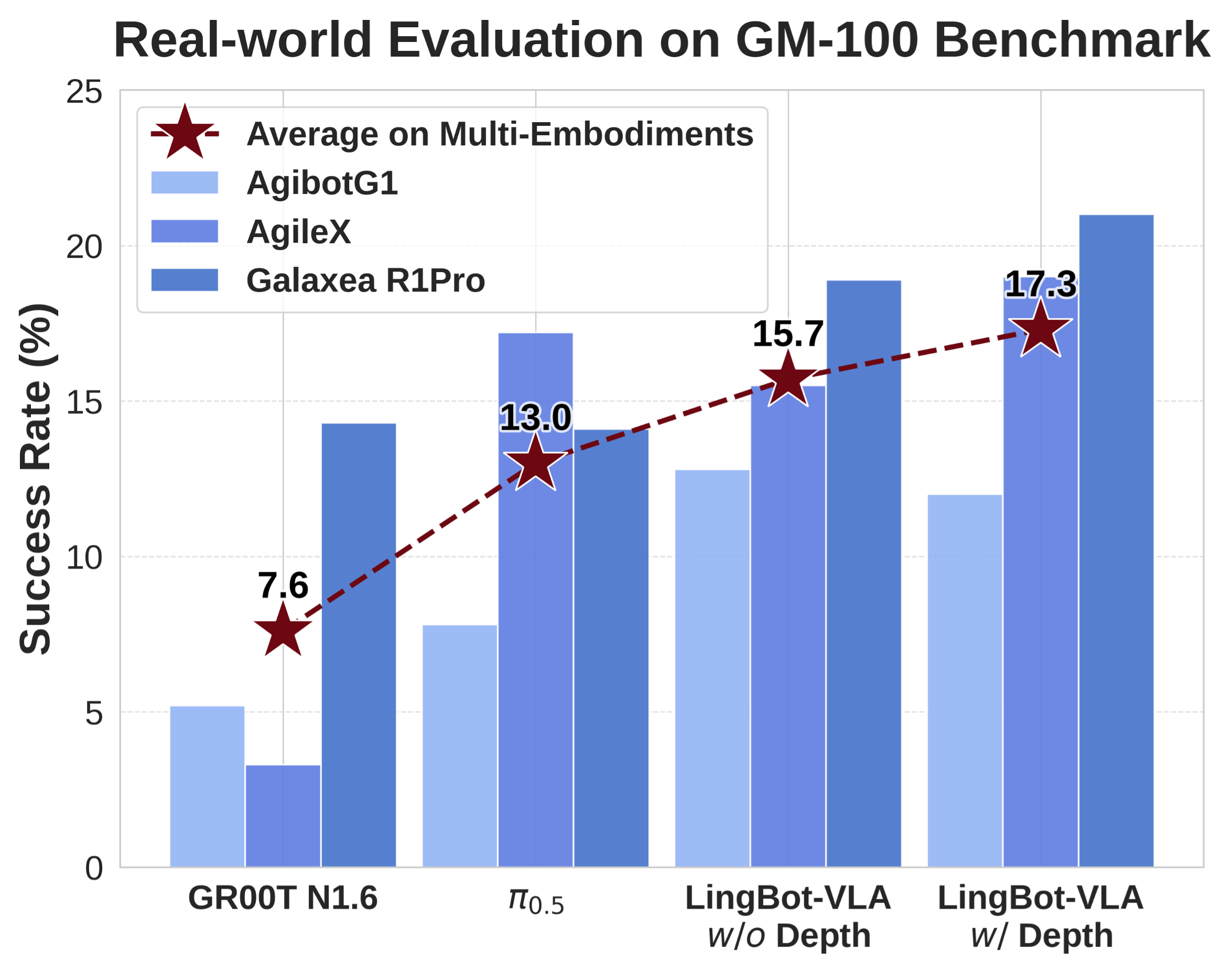

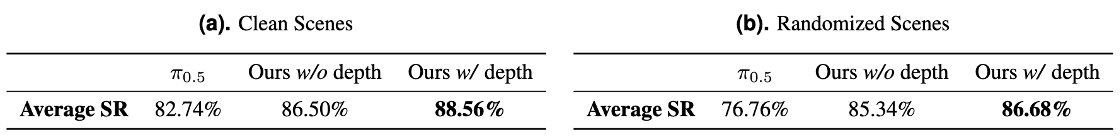

為支撐這一研究,螞蟻靈波科技構建了覆蓋9種主流雙臂機器人構型的20000小時真實訓練數(shù)據(jù)集,包括AgileX Cobot Magic、Galaxea R1Pro等機型。在上海交通大學開源的GM-100具身評測基準測試中,LingBot-VLA在3個不同機器人平臺上的跨本體泛化平均成功率從13.0%提升至15.7%(無深度信息)。引入深度信息后,其空間感知能力進一步增強,平均成功率攀升至17.3%。

同期開源的LingBot-Depth空間感知模型聚焦真實場景的深度補全需求。該模型依托奧比中光Gemini 330系列雙目3D相機進行數(shù)據(jù)采集與驗證,通過深度引擎芯片直出數(shù)據(jù)訓練優(yōu)化,可將不完整、受噪聲干擾的深度傳感器數(shù)據(jù)轉化為高質量三維測量結果。實驗表明,其在深度精度與像素覆蓋率兩項核心指標上超越業(yè)界頂級工業(yè)級深度相機,在NYUv2、ETH3D等基準測試中達到當前最優(yōu)水平,并保持視頻級時間一致性。

目前,LingBot-Depth模型已通過奧比中光深度視覺實驗室認證,在精度、穩(wěn)定性及復雜場景適應性方面達到行業(yè)領先標準。這一成果為機器人、自動駕駛汽車等智能終端提供了更精準的三維視覺解決方案,推動了具身智能技術在真實場景中的落地應用。