在人工智能技術快速發展的當下,如何讓復雜模型在資源受限的環境中高效運行,成為科研人員關注的重點。華為諾亞方舟實驗室的研究團隊近期取得重要進展,他們通過創新量化技術,成功降低了世界模型的計算需求,同時保持了關鍵性能指標。這項研究以預印本形式發布在arXiv平臺,編號為2602.02110v1,為AI技術在移動設備、嵌入式系統等場景的應用開辟了新路徑。

世界模型作為AI系統的核心組件,其功能類似于人類大腦中的"預演系統"。以機器人整理房間為例,該模型能在虛擬環境中模擬數百種行動方案,評估不同路徑的可行性。這種能力雖強大,但需要消耗大量計算資源。研究團隊以DINO-WM模型為實驗對象,發現其在執行50步連續預測時,計算負擔會呈指數級增長,如同圍棋高手同時推演數十種棋局變化。

量化技術的引入為解決這一難題提供了可能。該技術通過將模型參數從32位精度壓縮至8位、4位甚至更低,顯著減少存儲需求。但世界模型的特殊性帶來了獨特挑戰:其預測過程具有鏈式反應特征,初始環節的微小誤差會通過多步推演被持續放大。研究團隊形象地比喻,這如同計算復利時初始利率的微小偏差,經過多年累積會產生巨大差異。

實驗過程中,研究團隊系統評估了六種主流量化方法。RTN方法采用簡單的四舍五入策略,在處理均勻分布數據時表現尚可,但面對復雜數值范圍時效果欠佳。OMSE方法通過優化輸出誤差參數,在保持模型準確性方面表現突出。AWQ方法則聚焦關鍵權重,對影響預測結果的核心參數給予更高精度保護。SmoothQuant方法通過重新分配數值范圍,有效緩解了極端值導致的量化困難。

權重量化實驗揭示了多個重要發現。當采用8位精度時,所有測試方法均能維持原始模型性能,證明這是兼顧效率與效果的安全選擇。在4位精度場景下,分組量化策略展現出獨特優勢,其通過將權重劃分為多個小組分別處理,有效降低了局部誤差的影響。特別值得注意的是"時間恢復"現象:某些4位量化模型在初期表現不佳,但隨著預測步數增加,成功率反而逐步提升,顯示世界模型具有自我修正能力。

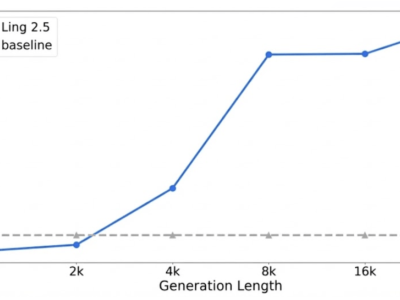

激活值量化面臨更大挑戰,因其數值分布隨輸入內容動態變化。研究對比了不同量化粒度策略:按張量量化為整個參數矩陣使用統一參數,實現簡單但適應性有限;按通道量化為每個通道單獨計算參數,能更好處理通道間差異;按令牌量化雖理論上精度最高,但實際測試中表現不穩定,尤其在長序列推理中易產生累積誤差。聯合量化實驗表明,W8A8(8位權重+8位激活)配置能穩定保持性能,而W4A4配置在長時間任務中表現波動明顯。

解剖實驗揭示了模型組件的差異化敏感性。編碼器作為環境感知模塊,其量化誤差會直接導致整個系統性能崩潰,如同地圖錯誤會誤導所有路徑規劃。預測器則表現出較強容錯能力,即使精度降低,系統仍可通過增加推理步數部分補償性能損失。這種非對稱特性為資源分配提供了重要依據:在極端資源約束下,應優先保證編碼器精度,對預測器可采用更激進壓縮策略。

不同任務場景對量化的敏感度存在顯著差異。在Wall環境中,量化主要影響視覺表示質量,編碼器精度下降會導致重構圖像出現明顯失真。而在PushT環境中,即使視覺表示看似正常,任務成功率也可能大幅下降,顯示規劃過程的數值穩定性更為關鍵。這種差異要求量化策略需根據具體任務特點進行調整,視覺敏感任務應重點保護編碼器,動作敏感任務則需確保整個預測鏈路的數值穩定。

長期規劃中的誤差累積效應是研究團隊關注的另一個重點。在嚴重量化條件下,目標函數優化過程會逐漸失效,如同迷霧中行走的旅人失去方向感。這種現象源于量化破壞了函數的連續性,使優化算法難以找到正確梯度方向。隨著推理步數增加,這種破壞效應會被持續放大,最終導致整個規劃過程失敗。

基于系統性實驗,研究團隊提出了實用部署建議:權重量化優先采用8位精度,如需進一步壓縮可選擇4位分組量化策略;激活值量化推薦使用張量級統一參數;聯合量化配置中W8A8是平衡性能與效率的最佳選擇;資源分配應遵循非對稱原則,重點保護編碼器精度。這些建議為在資源受限設備上部署世界模型提供了具體指導,對移動機器人、自動駕駛等領域的技術落地具有重要參考價值。

該研究不僅提供了有效的量化方案,更深化了對世界模型特性的理解。研究發現,這類模型的魯棒性呈現明顯層次結構:表示層穩定性是基礎,預測層具有一定自我修正能力。這種特性要求量化策略需兼顧單次推理精度與多步推理穩定性。研究還揭示了"時間恢復"等新現象,為開發更高效的壓縮算法提供了新思路。完整技術細節和實驗數據可通過arXiv編號2602.02110v1查詢。