近日,一份全面解析人工智能大模型核心概念的報告在網絡上引發熱議。該報告以通俗易懂的語言和生動形象的比喻,系統梳理了大模型從基礎架構到前沿應用的100個關鍵知識點,涵蓋模型訓練、優化技術、安全倫理等多個維度,為公眾理解這一復雜技術提供了重要參考。

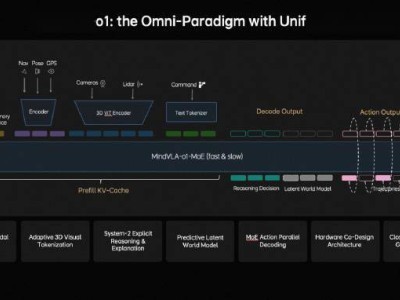

報告指出,Transformer架構是大模型的核心基礎,其自注意力機制能夠高效捕捉序列元素間的關聯關系。通過多頭注意力設計,模型可并行處理不同維度的語義信息,而位置編碼和詞嵌入技術則分別解決了序列順序識別和詞語向量化表示的難題。參數規模被視為衡量模型能力的重要指標,參數數量越多,模型處理復雜任務的能力越強,但同時也對計算資源提出了更高要求。

在訓練方法上,報告詳細區分了預訓練與微調兩個階段。預訓練階段通過海量無監督數據讓模型積累"常識知識",而微調階段則針對特定任務進行有監督的專業訓練。零樣本和少樣本學習技術的引入,使模型能夠在缺乏大量示例的情況下,通過已有知識推理完成新任務。提示工程和思維鏈等優化手段,則進一步提升了模型輸出的精準度。

生成式AI被視為大模型最重要的應用方向。報告解釋了溫度參數、Top-k/Top-p采樣等解碼策略如何平衡生成內容的隨機性與合理性,并介紹了模型蒸餾、稀疏化等壓縮技術如何解決訓練與部署過程中的資源瓶頸問題。MoE架構通過動態激活參數提升效率,而模型并行和數據并行技術則顯著加快了訓練速度。

安全與倫理問題在報告中占據重要篇幅。對齊技術、紅隊測試和安全護欄等手段被用于確保模型行為符合人類價值觀,而可解釋性和魯棒性研究則致力于提升模型決策的透明度和抗干擾能力。針對數據隱私保護,差分隱私和聯邦學習等技術提供了有效解決方案,同時防范模型泄漏、數據污染等潛在風險。

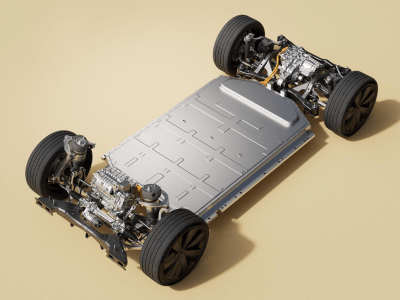

報告還關注了多模態學習、輕量化微調技術等前沿領域。LoRA和前綴微調等創新方法顯著降低了模型微調成本,而AI芯片和張量核心等專用硬件的發展則為大模型運行提供了硬件支撐。綠色AI、邊緣計算等新型應用模式,以及MaaS(模型即服務)等產業發展趨勢,也在報告中得到深入探討。