全球AI視頻生成領域近日迎來一匹“黑馬”——HappyHorse-1.0模型在Artificial Analysis發布的Video Arena榜單中掀起軒然大波。該模型以橫掃之勢占據三大核心賽道領先地位,其表現不僅刷新行業認知,更被業界視為AI視頻技術進入新階段的標志性事件。

在文本轉視頻(無音頻)賽道,HappyHorse-1.0以1332的Elo積分強勢登頂,領先第二名Dreamina Seedance 2.0近60分。圖像轉視頻(無音頻)賽道的表現更為驚人,1391分的成績直接改寫該榜單歷史紀錄。即便在技術難度最高的有音頻賽道,這匹“黑馬”仍以全球第二的排名緊追Seedance 2.0,展現出全方位的技術實力。

Video Arena榜單的權威性源于其獨特的評估機制。不同于廠商自報數據或單次演示,該榜單通過數千名真實用戶的“盲測”對比生成結果,采用Elo體系確保排名客觀性。參與測試的用戶在完全不知情的情況下,對兩段生成視頻進行直接比較,這種評估方式有效避免了主觀偏見和技術參數的誤導。

關于HappyHorse-1.0的研發背景,行業猜測聚焦于阿里系科技團隊。有消息稱,原快手副總裁、可靈技術負責人張迪加盟阿里后,帶領淘天集團“未來生活實驗室”團隊主導了該模型開發。這個成立僅一年多的實驗室,已聚集國內頂尖視覺AI人才,在多模態大模型領域取得突破性進展,國際頂會論文產出量持續攀升。

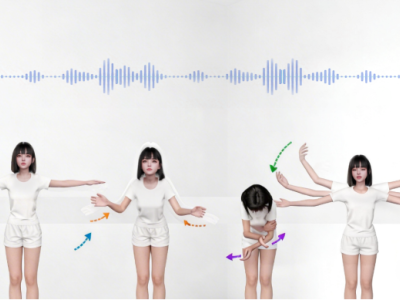

技術路徑方面,Transfusion統一多模態架構成為關鍵突破口。該架構創新性地將文本的自回歸預測建模與視覺信號的擴散模型整合在同一框架內,突破了傳統模型在跨模態理解上的局限。HappyHorse-1.0通過優化這種融合方式,在保持語言邏輯準確性的同時,顯著提升了視頻生成的流暢度和畫面質感,尤其在物理運動規律和聲畫同步性上表現突出。

這場技術革命正在重塑行業競爭格局。AI視頻生成已從“能否實現”的基礎階段,躍升至對物理真實性、運動連貫性、多模態對齊等綜合能力的嚴苛考驗。HappyHorse-1.0的崛起證明,只有經得起用戶反復對比驗證的算法,才能在激烈的技術迭代中占據主動。當前,全球主要AI實驗室正加速布局統一多模態架構,這場關于生成式AI底層技術的競賽已進入白熱化階段。