在人工智能技術持續突破的背景下,多模態大語言模型已從單一文本處理向圖文協同理解演進。然而這類系統在執行學術研究任務時的真實表現,特別是能否像專業研究者般完成資料收集、證據分析和引用規范的研究報告撰寫,始終缺乏系統性評估。近日,由國際多所頂尖高校與科技企業聯合完成的研究,首次構建了針對深度研究代理(DRA)的綜合性評測體系,為評估AI學術能力提供了新維度。

研究團隊開發的MMDeepResearch-Bench評測平臺(簡稱MMDR-Bench),設計了覆蓋21個學科領域的140個專家級任務。這些任務分為日常信息處理和學術研究兩大類,前者涉及產品說明解析、健康圖表解讀等場景,后者則包含科學圖表分析、技術原理圖闡釋等復雜任務。每個任務均由博士級專家設計,確保需要同時處理文本與視覺信息,且所有結論均可通過引用驗證。

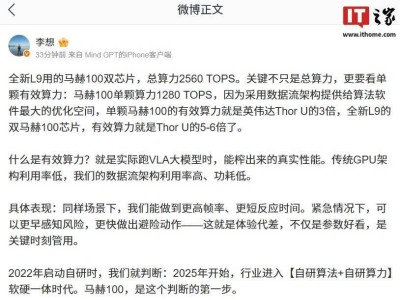

在對25個主流AI系統的測試中,Gemini深度研究系統以49.41分(滿分100)領跑,其優勢體現在證據質量和引用對齊能力。值得注意的是,不同模型在能力維度上呈現顯著差異:部分系統文本生成流暢但引用混亂,另一些雖能精準引用卻難以處理復雜圖表。研究特別指出,添加視覺處理模塊未必提升性能,某些模型在讀取表格數字、日期標簽等細節時錯誤率反而上升,暴露出當前視覺理解技術的局限性。

評測發現多模態整合與引用嚴謹性存在矛盾:某些系統能準確關聯圖文信息,但引用規范不足;專業研究代理雖擅長多步驟驗證,卻常在實體識別環節出錯。研究還揭示,模型性能提升的關鍵不在于規模擴張,而在于基礎架構優化與檢索交互設計。部分離線模型因檢索策略高效,甚至超越了具備網絡搜索能力的模型。

為驗證評估可靠性,研究團隊邀請12位領域專家進行獨立評審。結果顯示,完整評估框架與專家判斷的一致性達73.5%,相關性達96.4%,顯著優于傳統提示詞評估方法。這表明該體系能較準確地反映AI系統的真實研究能力。

Q&A環節中,研究團隊解釋了MMDR-Bench的獨特價值:該平臺通過標準化任務設計,首次實現了對AI學術研究能力的全流程評估。針對視覺能力反降性能的現象,團隊指出當前模型在處理微小文字、復雜排版等視覺細節時仍存在技術瓶頸。對于用戶使用建議,專家強調應建立"人機協作"機制,將AI定位為信息篩選工具而非最終決策者。