在人工智能領域,開源多模態模型長期面臨復雜推理能力不足的困境,與GPT-4o、Gemini等閉源模型存在顯著差距。這種差距并非源于模型架構或參數規模,而是高質量思維鏈密集型推理數據的嚴重匱乏。上海AI實驗室OpenDataLab團隊近期推出的MMFineReason框架,通過創新的數據合成方法,為破解這一難題提供了全新路徑。

傳統開源多模態數據存在兩大核心缺陷:數據類型失衡與推理質量低下。現有數據集中,簡單視覺問答(VQA)和自然圖像占比過高,而STEM圖表、邏輯謎題等高價值數據不僅稀缺,標注成本更居高不下。即便標注為"推理數據"的樣本,也普遍存在推理鏈條簡短、模板化嚴重、視覺與邏輯割裂等問題,難以支撐復雜推理任務訓練需求。

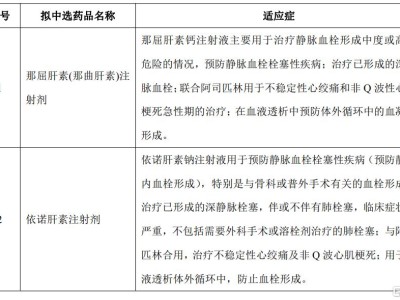

MMFineReason框架構建了全流程開源的數據生產管線,包含標準化處理、推理蒸餾和雙重過濾三大核心模塊。在標準化階段,研究團隊對數學、幾何、科學圖表等八大領域數據進行統一建模,建立跨模態數據Schema。推理蒸餾環節采用Qwen3-VL-235B-Thinking作為教師模型,強制遵循"視覺感知-邏輯推導-中間驗證-結論確認"的四階段框架,生成包含2910個token平均長度的詳細推理軌跡。

該框架最突破性的創新在于雙重過濾機制。首先通過正確性過濾剔除答案與推理過程不一致的樣本,隨后實施難度感知過濾,專門篩選出Qwen3-VL-4B模型"穩定失敗"的高挑戰樣本。這種精準的數據篩選策略,使得僅用7%(12.3萬條)的高難度數據,就能達到與全量180萬條數據相當的訓練效果。

基于該框架訓練的MMFineReason-4B模型展現出驚人性能,在復雜推理任務中超越Qwen3-VL-8B-Thinking,性能直逼參數規模大8倍的Qwen3-VL-30B-A3B-Thinking。更令人矚目的是MMFineReason-8B模型,其表現不僅擊敗Gemini-2.5-Flash等商業模型,更開始挑戰GPT5-mini-High等頂級開源模型。這種"以小博大"的性能躍遷,完全源于數據層面的結構化創新與推理密度提升。

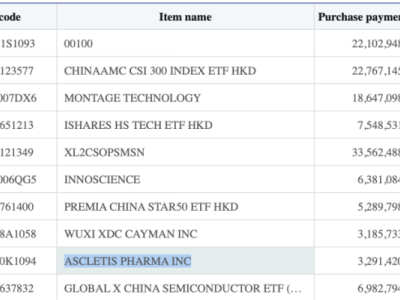

研究團隊構建的180萬條高質量數據集具有顯著領域特征:數學數據占比達79.4%,覆蓋幾何、微積分等深度學科;科學圖表數據占13.8%,聚焦物理、化學復雜分析;謎題與游戲數據占4.6%,通過抽象模式識別挑戰模型極限。這種高強度訓練帶來意外收獲:模型在STEM領域的深度訓練,反而提升了其在通用VQA任務中的表現,打破了專項訓練削弱通用能力的傳統認知。

該項目的開源內容包括完整數據集、訓練代碼和評估工具鏈。其中MMFineReason-1.8M為全量數據集,MMFineReason-586K剔除了簡單樣本,MMFineReason-123K則精選出最具挑戰性的數據子集。這種分層設計既滿足基礎研究需求,也為工業應用提供了高效訓練方案。項目已在Huggingface和GitHub平臺全面開放,為多模態大模型發展注入新動能。