社交媒體上,一場圍繞AI架構起源的激烈討論持續發酵。事件的導火索是“歐洲版OpenAI”Mistral首席執行官Arthur Mensch在訪談中的驚人表態——他聲稱中國開源模型DeepSeek-V3的架構基礎源自Mistral的技術方案。這一論斷迅速點燃全球開發者社區,引發對技術原創性與開源生態邊界的深度探討。

爭議焦點集中于技術演進的時間線與核心創新點。公開資料顯示,Mistral于2024年初推出首個稀疏混合專家模型(MoE),而DeepSeek團隊幾乎同步提交的論文僅比前者晚3天。技術社區通過對比原始論文發現,盡管兩者同屬SMoE架構,但設計理念存在顯著分野:Mistral側重工程優化路徑,而DeepSeek重構了算法底層邏輯,引入“細粒度專家分割”與“共享專家”機制,實現通用知識與領域知識的解耦。這種架構差異使得兩者在專家模塊的層級設計與知識分配方式上呈現本質區別。

戲劇性轉折出現在2025年末。開發者社區對Mistral3Large的逆向分析顯示,該模型底層架構與DeepSeek-V3首創的MLA技術存在高度相似性。這一發現引發技術圈對“技術回流”現象的熱議,部分專家指出,DeepSeek在MoE架構的創新實踐已形成顯著行業影響力,而Mistral的架構調整更像是技術追趕的應激反應。社交媒體上甚至出現調侃言論,稱某些機構試圖通過重構技術敘事來維持市場話語權。

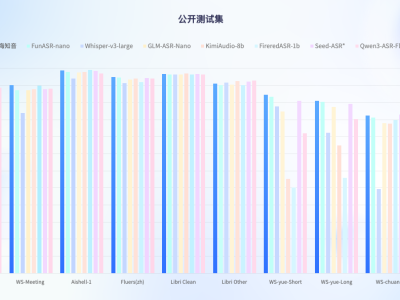

在這場技術路線之爭背后,全球AI實驗室的競爭焦慮愈發凸顯。DeepSeek團隊被曝正籌備2026年春節期間發布新一代模型,其性能指標可能再次突破現有邊界;與此同時,Mistral持續迭代Devstral家族產品,試圖在開源編程智能體領域重奪優勢地位。開源社區的開發者普遍認為,這種白熱化競爭客觀上推動了技術進步,但單純的技術路線爭論終需回歸模型性能的實證檢驗。

值得關注的是,Arthur Mensch在引發爭議的訪談中,也曾強調開源生態的核心價值在于“站在巨人肩膀上持續創新"。這種看似矛盾的表述,恰恰折射出當前AI領域的技術博弈困境:既需要開放協作的生態基礎,又面臨商業競爭的生存壓力。隨著模型復雜度指數級增長,技術溯源的難度與爭議性將持續存在,而最終裁決權始終掌握在客觀性能測試與真實場景應用之中。