拿捏機器人找準位置不迷路難題,代碼、檢查點已開源。

作者 | 程茜

編輯 | 漠影

機器人前瞻1月27日報道,今日,螞蟻集團旗下具身智能公司靈波科技正式開源高精度空間感知模型LingBot-Depth,搭載LingBot-Depth模型的奧比中光Gemini 330系列相機在深度精度和像素覆蓋率方面,均優于頂級深度相機。

螞蟻靈波公布的一系列下游任務實驗結果進一步表明,LingBot-Depth可在RGB與深度模態間,輸出精準對齊的潛在特征表示,讓靈巧手在抓取高度透明和反光物體時的成功率大大提升。

當下關于機器人落地應用的美好構想層出不窮,但要讓這些設想照進現實,有一個核心前提繞不開:機器人必須能與物理世界順暢交互。小到抬手從桌上取一杯水,大到完成各類復雜的實景作業,所有操作的第一步,都得讓機器人先明確一個關鍵問題:“我在哪?”

但當下常見的空間定位感知方式,會因鏡面反射、無紋理表面等情況產生深度誤差,就意味著機器人獲取的環境幾何信息是模糊、失真的。機器人連基礎的“我在哪”都無法明確,更無從談起后續的精準操作與交互,這正是LingBot-Depth模型要解決的痛點。

從行業價值來看,該模型的核心突破在于用算法創新彌補了硬件短板,無需更換高端傳感器,就能讓消費級RGB-D相機實現超高性能,這恰好契合了當前工業、服務機器人領域對高精度、低成本感知方案的迫切需求,也為具身智能三維空間感知能力從基礎層避障導航,向更高級別的復雜場景建模、人類級空間理解邁進提供了關鍵技術支撐。

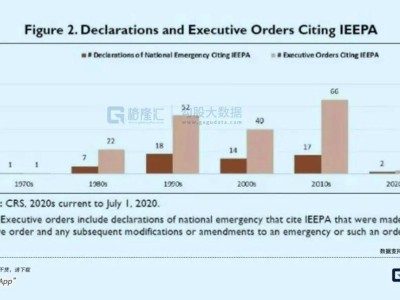

在NYUv2、ETH3D等主流3D視覺基準評測中,相較于PromptDA、PriorDA等業界主流深度補全模型,LingBot-Depth在室內場景下相對誤差(REL)降幅超70%,在高挑戰性的稀疏SfM任務中,均方根誤差(RMSE)也降低約47%。

目前,螞蟻靈波已經開源了代碼、檢查點,并計劃于近期開源300萬個RGB深度對,包括200萬個真實數據和100萬個合成數據。該公司此次將模型代碼與數據全鏈路開源,或倒逼RGB-D相機硬件的優化升級,進一步提升模型在真實長尾場景中的魯棒性,讓機器人、自動駕駛汽車等產品加速走進現實場景。

▲GitHub開源主頁

01.

解鎖機器人高精度空間感知

實測性能超越主流模型

一句話總結,LingBot-Depth模型解決的是讓機器人具有精確的空間視覺感知能力,也就是看清楚、知道自己在哪里。

先來看下這一模型的性能表現。根據螞蟻靈波公開的技術報告,其實驗結果表明,LingBot-Depth模型在深度精度與像素覆蓋率兩項核心指標上均超越業界頂級深度相機。

對于機器人而言,其在抓取透明、反光物體時時常會出現判斷失誤的情況。測試結果顯示,LingBot-Depth模型透明收納箱抓取成功率從0%提升至50%,同時在多種反光和透明物體上提升了30%~78%的抓取成功率。

具體來看,在深度補全任務上,該模型與主流的深度補全模型OMNI-DC、PromptDA、PriorDA相比,基于分塊深度掩碼法和稀疏攝影測量(SfM)深度輸入法進行了效果對比。LingBot-Depth模型在室內、室外場景下的預測深度與真實深度的偏差都相對更小,顯著優于當前主流的基線方法。

▲LingBot-Depth模型與主流模型相比的效果

在分塊深度掩碼法的評測設置下,LingBot-Depth模型在不同難度等級中性能均持續優于其他模型,證明了該模型面對重度掩碼和噪聲干擾時具備較優抗干擾能力。

在稀疏攝影測量(SfM)深度輸入法設置下,LingBot-Depth模型生成的深度圖具備更清晰的深度邊界和更連貫的結構特征,并且在遮擋嚴重或觀測信息稀疏的區域優勢更為明顯。

▲兩種協議下的模型對比效果

如下圖所示,LingBot-Depth模型生成的圖像包含更清晰的邊界和更完整的結構。

單目深度估計能力上,LingBot-Depth模型在10項基準上的表現均優于視覺模型DINOv2,其測試結果顯示,LingBot-Depth模型的預訓練范式可以有效地將3D幾何知識提煉到編碼器中,提高其從單目圖像推斷深度結構的能力。

研究人員還將LingBot-Depth模型,作為強單目深度先驗融入FoundationStereo模型中,結果顯示加速雙目匹配模型訓練后,FoundationStereo收斂更快。

從性能表現來看,LingBot-Depth 模型不僅驗證了其技術路徑的有效性,更凸顯了其背后深刻的行業價值。

最直觀的就是,LingBot-Depth模型有效攻克了機器人空間感知的核心痛點,即便是傳統相機難以捕捉的低紋理、遮擋或弱光區域,機器人也能通過該模型實現清晰感知。同時,它顯著縮小了普通消費級RGB-D相機與高端深度相機之間的性能差距,讓低成本設備也能輸出接近專業級的深度數據,為機器人等各類智能設備的空間感知能力筑牢了技術根基。

02.

LingBot-Depth要讓機器人看清路、定準位

就像人類出行需要通過視覺清晰感知路況、判斷距離、定位自身位置一樣,機器人執行任務時也依賴精準的空間視覺感知能力,既需要看懂周圍的三維布局,還要準確定位自己的坐標。

這種能力是機器人實現自主導航、避障和復雜操作的底層基礎,而追求精確的三維感知已成為基于物理的AI研究的核心支柱,其重要性不言而喻。

從行業落地視角來看,讓機器人實現穩定、有效的空間感知,需滿足三大核心標準:具備絕對度量尺度、能輸出像素級對齊的稠密幾何信息、支持無需高算力后處理的實時采集。而目前業內唯一能同時滿足這些實時性要求的成像方案,唯有RGB-D相機。

然而,RGB-D相機的硬件短板卻成為技術規模化應用的關鍵掣肘之一。受固有的硬件局限影響,基于雙目的深度相機方式,會通過兩個鏡頭從略有差異的視角同時拍攝場景,系統通過匹配兩幅圖像中的對應點來計算深度。

但該相機在面對光滑、鏡面反射、反光等復雜光照條件,其依靠像素級局部紋理進行推理、猜測補全缺失圖像的策略就會失效,而這些復雜場景在真實的工廠、家庭等環境很常見。

LingBot-Depth模型的出現,正是為破解這一行業核心痛點提供了切實可行的技術路徑,其背后的殺手锏就是MDM(掩碼深度建模)。

MDM相對應的就是此前主流MAE(掩碼自編碼器)方法的局限性,MAE在訓練過程中無法學習和理解真實物理世界的空間幾何規律。

而MDM在訓練時將RGB-D傳感器的天然深度缺失作為“原生掩碼”,將傳感器失效區域視為可學習的結構線索而非簡單噪聲,通過掩碼深度建模(Masked Depth Modeling, MDM)機制充分利用 RGB 圖像中的視覺上下文信息,對缺失深度區域進行智能推斷與補全。模型在補全真實深度缺失的過程中,可以學出貼合物理世界的度量級、高精度完整深度表示。

簡單說,MDM就是將傳感器的缺陷變成了訓練AI的素材,讓AI學習真實世界的物理規則,而不是人工編的假規則,這使得最后練出的AI能精準測出真實的3D距離。

如此一來,模型便能逐步習得這類空間感知規律:當識別到玻璃類的視覺外觀與反射特征時,就能精準推斷出其對應的深度范圍。

在此之上,基于統一單目深度估計和深度補全的目標,MDM框架可以作為通用的多功能模型,從任意RGB-D輸入生成度量尺度、像素對齊的密集深度圖。

機器人行業正邁向規模化應用落地的關鍵階段,螞蟻靈波在MDM機制上的探索在攻克精準空間感知這一核心難題上提出了新解法,或加速機器人真正邁入自主感知、自主決策、自主執行的智能新階段。

03.

千萬級樣本煉就機器人“火眼金睛”

讓機器人靈巧操作落地可期

找對可行路徑,下一步要做的就是落地實現。

為支持大規模MDM訓練,研究人員首先搭建了一套可擴展的數據整理流程,實現原始傳感器數據與可靠監督信息的高效對接。該流程設計兩大并行數據分支,分別是基于自托管的3D資產生成合成數據,以及通過模塊化3D打印采集裝置完成實景數據采集,這一裝置兼容主動立體相機(Intel RealSense、奧比中光Gemini)和被動立體相機(ZED)等多款消費級RGB-D相機。

基于這一套設計,其累計獲取了100萬個合成樣本、200萬個真實世界樣本,所有樣本均包含同步的RGB圖像、原始傳感器深度數據及立體圖像對。

其中立體圖像對的偽深度監督,由基于FoundationStereo、經合成數據訓練的自定義立體匹配網絡實現。研究人員還融合多個公開RGB-D數據集豐富了數據語料庫,最終構建出包含1000萬條樣本的多樣化高質量訓練集。

結合該RGB-D語料庫,研究人員采用掩碼深度建模方式對ViT-Large模型進行預訓練,通過注意力機制將度量幾何信息融入語義標記,可有效提升RGB-D相機的空間感知質量。

在可擴展雙支數據整理流程、超大規模高質量訓練集、針對性預訓練優化感知這樣的全棧技術創新下,LingBot-Depth模型已經有了落地到實際應用的潛力。

因此,研究人員基于LingBot-Depth模型開展了多組實驗驗證,選用Orbbec Gemini-335相機作為RGB-D輸入設備,完成了3D點跟蹤、靈巧手抓取等典型任務的實測驗證。

可以看到在3D點跟蹤案例中,當場景包含大面積的玻璃時,原始深度傳感器會嚴重失效,經LingBot-Depth模型優化后的深度數據,能夠生成更加平滑和精確的相機軌跡。

▲原始相機和基于LingBot-Depth模型優化的3D跟蹤效果對比

還有真實世界的靈巧手抓取,其采用了配備X Hand-1靈巧手的Rokae XMate-SR5機械臂、用于感知的Orbbec Gemini 335 RGB-D相機。LingBot-Depth模型在抓取高度透明物體時的成功率達到50%,但原始方法完全無法抓取。

▲靈巧手抓取成功率對比

雖然這些只是在實驗室的測試,但這些測試場景均對標了機器人落地應用中的高頻實際場景,已充分展現出該技術方案的高實用性與落地潛力。

04.

結語:讓機器人看懂物理世界的關鍵一步

整體而言,LingBot-Depth模型在解決機器人空間感知能力核心痛點上更進一步,既實現了感知性能的提升,又大幅降低了技術落地成本,為各類智能應用的開發筑牢了技術基礎,是推動機器人真正“看懂”物理世界的關鍵突破。

對于開發者而言,其無需再從零開展空間感知的基礎研究,可直接基于該模型快速搭建各類應用,這將大幅加速一眾智能設備的研發與落地進程,讓機器人、自動駕駛汽車等產品更快從技術概念走進現實場景。