在人工智能技術迅猛發展的當下,AI代理作為能夠自主執行任務的智能助手,正逐漸滲透到各個領域。從編寫代碼到深度研究,從解決復雜問題到專業領域應用,AI代理展現出了強大的能力。然而,一個值得關注的現象是,盡管技術不斷進步,但大多數普通用戶并未真正感受到這些先進AI帶來的顯著變化。

這種技術能力與用戶體驗之間的落差,引發了科研界的深入思考。xbench實驗室的研究團隊針對這一問題展開了系統性研究,并在arXiv期刊上發表了相關成果。研究指出,當前AI評估體系存在明顯偏差,過度聚焦于提升任務難度,卻忽視了任務類型的多樣性,導致評估結果與普通用戶的實際需求脫節。

研究團隊形象地將這種現象比喻為"超級跑車在停車場繞圈"——AI代理雖然具備處理高難度任務的能力,但在應對日常需求時卻表現欠佳。為了更準確地評估AI代理的實際價值,研究團隊開發了名為"AgentIF-OneDay"的新型評估框架,重點考察AI代理在24小時內能為用戶解決哪些實際問題。

這個創新框架包含三個核心評估維度:開放式工作流程執行、潛在指令推理和迭代式精煉。開放式工作流程執行測試AI代理能否嚴格按照用戶提供的詳細步驟完成任務,就像廚師必須按照菜譜精確操作;潛在指令推理考察AI代理從材料中自動推導隱含規則的能力,類似于通過觀察照片布置聚會現場;迭代式精煉則模擬人機協作場景,要求AI代理根據反饋持續優化工作成果。

研究團隊設計了104個涵蓋工作、生活和學習場景的測試任務,每個任務都包含詳細的評分標準。以制定旅行計劃為例,AI代理不僅要訪問官網確認會議地點,還需交叉驗證信息、獲取基本數據、檢查日程安排,最終生成兩種不同需求的旅行方案。這種設計確保了評估的全面性和實用性。

在數據集構建方面,研究團隊采用了人工設計與自動生成相結合的方法。人工部分由領域專家提交原創問題,經過多階段審核確保質量;自動部分則通過分析種子任務提取工作流程模板,生成多樣化的擴展任務。這種混合方法既保證了數據質量,又提高了生成效率。

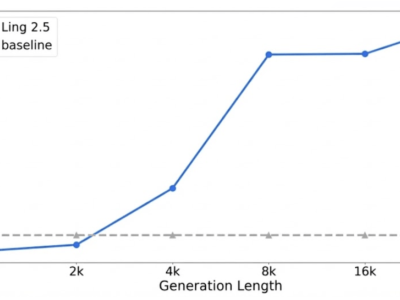

實驗選取了四個主流AI代理進行測試,結果顯示Manus總體表現最佳,但在不同場景下各代理優勢各異。ChatGPT-Agent在工作場景得分最高,Manus在生活場景表現突出,Genspark則在學習場景領先。進一步分析發現,所有代理在隱性指令推理方面普遍較弱,這是當前技術需要突破的關鍵點。

評估體系的設計充分體現了科學性和公平性。每個任務都制定了詳細的評分標準,分為獎勵項和懲罰項,既關注任務完成度,也重視錯誤容忍度。為確保評估準確性,研究引入了大語言模型作為評審,并與人工標注結果進行對比驗證。

具體案例分析揭示了AI代理的實際表現。在制作PPT任務中,部分代理能較好遵循格式要求,但文章數量不足;在跨平臺購物任務中,有的代理能處理價格約束,卻在多模態推理方面存在局限。這些案例為技術改進提供了明確方向。

研究還探討了自動化評估的可靠性問題。通過對比多個大語言模型的評分結果,發現Gemini-3-Pro-preview與人類評審的一致性最高,但在抽象概念理解上仍存在差距。這表明自動化評估技術雖已成熟,但在某些主觀評判方面仍需完善。

這項研究對AI代理的發展具有重要指導意義。它表明基礎代理能力已趨于商品化,未來競爭將集中在產品設計、用戶體驗和場景優化等方面。研究團隊提出,下一步應將評估范圍擴展到更長的時間維度,構建更全面的"OneWeek"基準。

對于普通用戶而言,這項研究傳遞了一個積極信號:AI代理正在從技術演示向實用工具轉變。雖然目前還存在諸多不足,但隨著技術進步和產品優化,能夠真正理解用戶需求、提供有價值幫助的AI助手正在成為現實。

該研究的完整論文可通過arXiv編號2601.20613v2查詢,相關代碼和數據集分別在GitHub和Hugging Face平臺公開,為研究者提供了寶貴的參考資源。