字節(jié)跳動旗下豆包大模型近日完成重大技術迭代,正式發(fā)布2.0版本。此次升級圍繞多模態(tài)交互、復雜任務處理及開發(fā)效率三大核心方向展開,同步推出四款針對不同場景優(yōu)化的模型變體,構建起覆蓋通用與專業(yè)領域的完整產品體系。新版本在技術架構與實際應用層面均實現(xiàn)突破性進展,標志著人工智能技術向現(xiàn)實場景落地邁出關鍵一步。

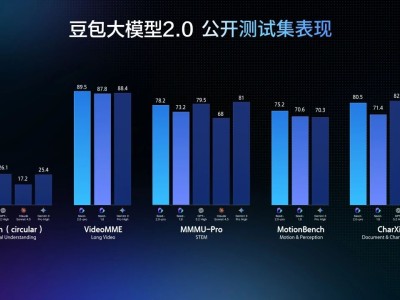

在多模態(tài)能力建設方面,豆包2.0展現(xiàn)出顯著優(yōu)勢。該模型通過創(chuàng)新的空間感知算法與動態(tài)場景理解技術,在視覺推理領域達到國際領先水平。實測數(shù)據(jù)顯示,其Pro版本在TVBench測評中超越同類競品,在EgoTempo基準測試中更達到人類平均表現(xiàn)之上,能夠精準識別視頻中的動作節(jié)奏變化。針對長視頻應用場景,模型支持實時問答與環(huán)境感知功能,可自動完成健身指導、穿搭建議等交互任務,實現(xiàn)從被動響應到主動服務的模式轉型。例如在健身場景中,系統(tǒng)能通過攝像頭捕捉用戶動作,實時糾正姿勢并提供強度建議。

針對不同場景的差異化需求,新版本構建了層次分明的模型體系。旗艦版豆包2.0 Pro通過深度優(yōu)化推理引擎,在SuperGPQA知識測試中得分超越GPT 5.2,并在HealthBench醫(yī)療基準測試中登頂榜首。該模型在數(shù)學奧賽IMO、編程競賽ICPC等權威評測中斬獲金牌,工具調用準確率較前代提升40%。面向成本敏感場景,Lite版本在保持綜合性能超越1.8代的同時,將推理成本壓縮至行業(yè)平均水平的十分之一,特別適合大規(guī)模部署需求。Mini版本則針對低延遲場景優(yōu)化,支持每秒處理數(shù)千次并發(fā)請求,可滿足實時交互類應用的嚴苛要求。

編程開發(fā)領域迎來效率革新,豆包2.0 Code與TRAE開發(fā)平臺實現(xiàn)深度整合。新模型強化了代碼庫解析能力,可自動識別項目架構并生成適配代碼。在"TRAE春節(jié)小鎮(zhèn)"互動項目開發(fā)中,開發(fā)者僅需5輪提示詞即完成復雜場景搭建,開發(fā)效率較傳統(tǒng)流程提升80%。模型內置的智能糾錯機制能實時檢測邏輯漏洞,在Agent工作流中將調試時間縮短65%。目前該版本已作為TRAE中國版的核心引擎,支持圖片理解與多模態(tài)推理功能,為開發(fā)者提供更高效的創(chuàng)作工具。

技術架構層面,豆包2.0通過知識蒸餾與強化學習技術,將真實世界數(shù)據(jù)覆蓋率提升至92%。其創(chuàng)新的動態(tài)注意力機制可自動調整計算資源分配,在處理長文本時保持上下文連貫性。火山引擎同步開放API服務,企業(yè)開發(fā)者可靈活調用不同量級的模型能力,支持從移動端到云服務的全場景部署。內部測試顯示,新版本在物流路徑規(guī)劃、金融風控等垂直領域的任務完成率較前代提升35%,展現(xiàn)出強大的場景適應能力。