AI算力領域的競爭格局正經歷深刻變革,推理環節取代訓練成為行業焦點。申萬宏源最新研究報告指出,隨著大模型商業化進程加速,2026年全球算力產業將圍繞推理需求展開全面重構,Token消耗量級與技術范式將發生根本性轉變。這一判斷得到產業動態的強力支撐:英偉達計劃在下月GTC大會發布整合LPU技術的全新推理芯片,OpenAI已鎖定該產品作為核心采購方,同時與Cerebras達成數十億美元計算合作,形成訓練與推理雙線布局的戰略轉向。

推理需求爆發呈現結構性特征。申萬宏源數據顯示,春節期間國內頭部模型推理量呈現指數級增長:豆包除夕當日處理633億Tokens,元寶月活突破1.14億,千問春節活動吸引超1.2億用戶參與。全球模型聚合平臺OpenRouter統計顯示,2月第三周中國模型調用量達4.12萬億Tokens,較美國模型高出40%,次周更以5.16萬億Tokens創歷史新高,全球前五模型中中國占據四席。這種爆發式增長源于兩大驅動力:Claude等模型加速商業化落地,推出多款行業插件;openclaw、千問Agent等智能體產品進入真實生產場景,每次任務執行均需海量推理算力支撐。

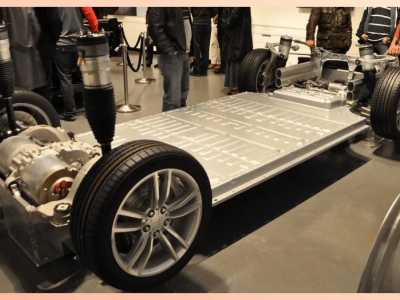

專用推理芯片正顛覆傳統技術路線。英偉達斥資200億美元獲取Groq核心技術許可,并吸納其核心團隊,標志著頂級廠商正式認可純推理芯片價值。LPU架構通過專項優化解碼延遲和內存帶寬兩大瓶頸,在推理場景展現顯著效率優勢。據華爾街見聞報道,英偉達新品可能采用下一代Feynman架構,通過3D堆疊技術深度整合LPU與SRAM,形成ASIC+LPU-SRAM+SSD的推理端標準方案。這種技術分工格局下,訓練端繼續沿用GPU-HBM組合,而推理芯片市場將迎來結構性機遇。

系統架構革新推動算力層級分化。申萬宏源研究指出,Agent應用場景對延遲、吞吐和思考深度的復合需求,催生三層網絡架構:快反應層采用SRAM加速芯片實現微秒級響應;慢思考層依賴多核CPU集群處理復雜邏輯;記憶層通過Bluefield4 DPU管理SSD存儲長期記憶。這種架構變革促使英偉達調整硬件策略,本月宣布與meta完成首次大規模純CPU部署,支持廣告定向智能體運行,打破以往GPU捆綁銷售模式。數據顯示,純CPU方案在特定工作負載下可降低37%成本,預示CPU在推理生態中的地位將持續提升。

國產算力突破形成新變量。新一代國產推理芯片實現三大技術躍遷:支持FP8/MXFP8等低精度格式,算力達1-2P;采用SIMD/SIMT雙模型設計提升向量處理能力;互聯帶寬提升至2TB/s。更引人注目的是PD分離架構創新,通過自研兩種規格HBM分別構建PR(推理預填充)和DT(解碼訓練)版本,其中PR版本采用低成本存儲方案,可使預填充階段投資成本下降42%,預計2026年一季度量產。供應鏈數據印證突破成效:某頭部封測企業2.5D封裝收入從2022年0.5億元激增至2024年18.2億元,顯示國產芯片量產能力顯著增強。

這場算力革命正在重塑產業生態。OpenAI與英偉達、Cerebras的多邊合作,暴露出頭部企業構建技術護城河的緊迫性;英偉達從硬件供應商向系統解決方案商的轉型,預示產業價值鏈將向應用層延伸;國產芯片通過架構創新實現彎道超車,為全球算力多元化提供新選項。當推理算力成為決定AI商業化的核心要素,這場圍繞Token消耗的競爭才剛剛拉開帷幕。