中國科學技術大學腦認知智能感知教育部重點實驗室聯合華為技術有限公司、天津大學智能與計算學院,在國際學習表征會議(ICLR)上發表了一項突破性研究。該成果通過構建統一理論框架,首次系統解釋了人工智能大語言模型中復雜的注意力模式形成機理,并為模型優化提供了全新思路。這項編號為arXiv:2601.21709的研究,在理論構建與工程應用層面均取得重要進展。

注意力機制作為大語言模型的核心組件,其運行模式長期困擾著科研人員。研究團隊發現,不同模型在處理文本時會產生三種典型模式:部分模型像聚光燈般反復聚焦關鍵詞匯,另一些如掃描儀般按序移動關注點,還有部分呈現周期性變化特征。這些看似隨機的行為模式,實則遵循著以"查詢自相似性"為核心的時間演化規律。研究人員通過構建"時間注意力模式可預測性分析"(TAPPA)框架,揭示了查詢向量在時間維度上的變化特征,是決定注意力分布形態的關鍵因素。

該理論框架的創新性體現在將注意力模式與時間連續性建立數學關聯。研究顯示,當查詢向量在相鄰時刻保持高度相似時,注意力分布呈現穩定可預測特征;反之則產生隨機波動。這種特性類似于車輛行駛軌跡:平穩駕駛時路線可預測,急加速轉彎時軌跡難以捉摸。通過量化這種時間連續性,研究團隊成功預測了重訪模式、序列模式和季節性模式等已知現象,并發現新的模式類型。

旋轉位置編碼(RoPE)技術的幾何特性在理論驗證中發揮關鍵作用。這種將詞匯位置信息轉化為旋轉角度的設計,使得注意力計算僅依賴相對位置關系。研究團隊通過控制實驗證實,低頻通道主導時產生重訪模式,高頻通道激活時形成周期性條紋,而輸入文本周期性與編碼周期共振時則出現季節性模式。這些發現不僅解釋了現有模型的行為特征,還為定制化注意力模式提供了理論依據。

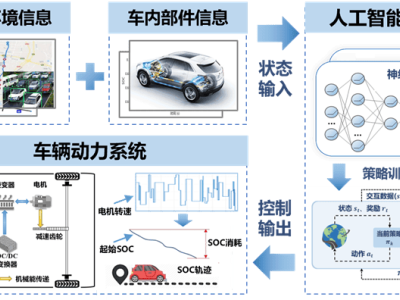

在工程應用層面,該理論催生出兩項突破性技術。針對模型處理長文本時的內存瓶頸,研究團隊提出動態鍵值緩存分配策略。通過評估各層的查詢自相似性,系統自動為不同注意力頭分配差異化緩存預算:穩定模式層獲得較少資源,檢索模式層保留更多緩存。實驗表明,在嚴格預算限制下,該方法在LongBench基準測試中的性能顯著優于現有技術。

模型剪枝領域同樣取得重要進展。傳統方法依賴復雜指標評估結構重要性,而新方法通過測量查詢自相似性,快速識別可壓縮層。結合塊影響力分析后形成的復合指標,在高剪枝率場景下仍能保持模型性能。測試數據顯示,43%結構剪枝后,優化模型在多個任務中的表現明顯優于傳統方法,驗證了理論指導的精準性。

實驗驗證環節展現了理論預測與實際觀測的高度吻合。通過對Llama-3.1和Qwen2.5等主流模型的分析,研究人員發現查詢自相似性呈現層次化分布特征:早期層普遍具有高相似性,中間層出現分化,后期層檢索行為增多。控制實驗中,調整RoPE主導通道位置后,注意力圖中的周期性條紋間距嚴格遵循理論公式,誤差控制在極小范圍內。

該研究的數學基礎構建于嚴謹的定理體系。研究團隊證明了注意力波動幅度與查詢變化程度存在精確數學關系,為量化不可預測性提供工具。對于可預測模式,推導出的數學公式精確描述了重訪模式的穩定性條件、序列模式的平移特性以及周期性條紋的間距計算方法。這些成果不僅解釋現有現象,更為開發新型模型架構指明方向。

技術創新體現在完整的方法論體系構建。查詢自相似性指標采用余弦相似度與滑動窗口計算方案,在保持時間敏感性的同時確保計算效率。工程應用中,研究團隊開發出調整因子將理論指標與傳統方法融合,形成漸進式優化策略。配套工具鏈包含分析平臺、驗證系統和部署接口,為后續研究提供完整基礎設施。

這項成果對人工智能發展產生多維度影響。理論層面,用統一框架解釋復雜現象的研究范式,推動領域從經驗主義向系統科學轉變。工程層面,優化技術使模型在移動端部署成為可能,云端服務成本有望降低。安全領域,可預測的注意力行為為構建可控AI系統提供新思路。研究團隊已發現不同文本類型可能激發獨特注意力模式、多語言模型行為規律等新問題,相關探索正在持續推進。