在科研領域,緊跟學術前沿動態是科學家的核心需求,但每年數以百萬計的學術論文發表量,讓信息整合成為巨大挑戰。盡管人工智能技術展現出快速處理海量數據的能力,但內容失真問題始終制約其應用——通用模型常因訓練數據時效性不足,導致引用過時或虛構文獻。

針對這一痛點,華盛頓大學與艾倫人工智能研究所聯合研發的開源模型OpenScholar,通過創新技術架構實現了突破。該模型構建了包含4500萬篇學術論文的檢索庫,并采用檢索增強生成技術,使其在完成初始訓練后仍能持續更新知識庫,確保答復內容基于最新研究成果。研究團隊特別開發的跨領域評測基準ScholarQABench,包含3000條專業檢索查詢和250篇領域專家撰寫的長文答復,為系統性能驗證提供了科學標準。

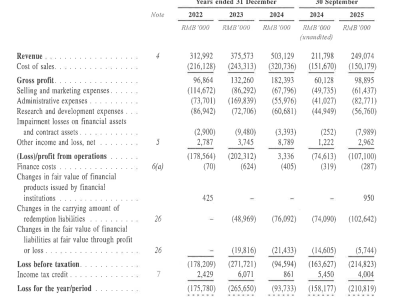

在對比測試中,OpenScholar展現出顯著優勢。與GPT-4o、meta旗下兩款頂尖模型相比,該系統在準確性、內容相關性和撰寫質量三個維度均表現卓越。盲評實驗顯示,16位科學家在51%的案例中更傾向選擇OpenScholar生成的答復;當將其引用機制與GPT-4o結合時,偏好率提升至70%;而單純使用GPT-4o原生內容的偏好率僅32%。研究團隊強調,這種優勢源于系統對學術論文的深度依賴——通過排除網絡博客等非專業信源,確保引用權威性。

項目負責人漢娜內·哈吉希里齊指出,系統上線后收到的訪問量遠超預期,科研人員的使用反饋證實了開源透明模式的重要性。第一作者淺井朱里透露,研發初期嘗試用谷歌搜索數據訓練模型時,曾出現引用無關論文、單篇引用過度等問題,這促使團隊轉向純學術論文數據庫,并優化系統靈活性以適應動態更新的研究文獻。

目前,OpenScholar的代碼、數據集和演示版本已全部開源,全球科研人員可自由使用并參與改進。基于該技術成果的迭代模型DR Tulu正在研發中,新系統將具備多步驟檢索能力,能夠聚合跨領域信息生成更全面的研究答復。這種開放協作模式已產生實際效應——多位同行在現有框架基礎上優化模型,顯著提升了特定領域的回答質量。