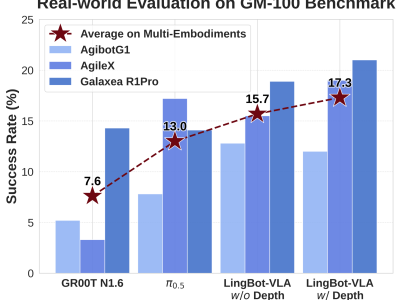

螞蟻集團旗下具身智能公司靈波科技近日宣布開源高精度空間感知模型LingBot-Depth,該模型通過算法創新顯著提升了消費級RGB-D相機的深度感知能力,在機器人領域引發廣泛關注。搭載該模型的奧比中光Gemini 330系列相機在深度精度和像素覆蓋率等核心指標上,已超越行業頂級深度相機,為機器人精準交互提供了關鍵技術支撐。

在機器人落地應用過程中,空間定位感知是核心前提。傳統RGB-D相機受硬件限制,在鏡面反射、無紋理表面等場景下易產生深度誤差,導致機器人無法準確判斷自身位置。LingBot-Depth模型通過掩碼深度建模(MDM)機制,將傳感器失效區域視為可學習的結構線索,利用RGB圖像中的視覺上下文信息智能推斷缺失深度,從而生成貼合物理世界的高精度完整深度表示。這一創新使機器人在抓取透明、反光物體時的成功率大幅提升,測試中透明收納箱抓取成功率從0%提升至50%,多種反光和透明物體的抓取成功率提高30%~78%。

技術評測顯示,LingBot-Depth模型在主流3D視覺基準數據集NYUv2、ETH3D上的表現遠超PromptDA、PriorDA等業界主流模型。在室內場景下,其相對誤差(REL)降幅超70%;在高挑戰性的稀疏SfM任務中,均方根誤差(RMSE)降低約47%。該模型生成的深度圖具備更清晰的邊界和更連貫的結構特征,尤其在遮擋嚴重或觀測信息稀疏的區域優勢明顯。在單目深度估計任務中,LingBot-Depth在10項基準上的表現均優于視覺模型DINOv2,其預訓練范式有效將3D幾何知識融入編碼器,提升了從單目圖像推斷深度結構的能力。

為支持大規模MDM訓練,研究團隊構建了包含1000萬條樣本的多樣化高質量訓練集。該數據集通過自托管3D資產生成合成數據,并利用模塊化3D打印采集裝置完成實景數據采集,兼容多款消費級RGB-D相機。所有樣本均包含同步的RGB圖像、原始傳感器深度數據及立體圖像對,其中立體圖像對的偽深度監督由自定義立體匹配網絡實現。結合這一數據集,研究團隊采用掩碼深度建模方式對ViT-Large模型進行預訓練,通過注意力機制將度量幾何信息融入語義標記,顯著提升了RGB-D相機的空間感知質量。

在實際應用驗證中,LingBot-Depth模型展現出高實用性與落地潛力。在3D點跟蹤任務中,面對大面積玻璃場景時,原始深度傳感器嚴重失效,而經該模型優化后的深度數據能夠生成更平滑精確的相機軌跡。在靈巧手抓取實驗中,配備X Hand-1靈巧手的Rokae XMate-SR5機械臂使用Orbbec Gemini 335 RGB-D相機,在抓取高度透明物體時的成功率達到50%,而原始方法完全無法完成抓取。這些測試場景均對標機器人落地應用中的高頻實際場景,充分證明了該技術方案的有效性。

目前,靈波科技已開源LingBot-Depth模型的代碼和檢查點,并計劃近期開源300萬個RGB深度對數據,包括200萬個真實數據和100萬個合成數據。這一舉措或將推動RGB-D相機硬件的優化升級,進一步提升模型在真實長尾場景中的魯棒性。通過降低技術落地成本,該模型為各類智能應用的開發奠定了堅實基礎,開發者可直接基于該模型快速搭建應用,加速機器人、自動駕駛汽車等產品從技術概念向現實場景的轉化。